A Moutain View, Google continue ses travaux pour démocratiser l’intelligence artificielle dans les entreprises. En janvier, le groupe californien lançait l’outil AutoML Vision, pour construire des modèles de vision personnalisés basés sur sa technologie de reconnaissance d'images propriétaire. Et faciliter le travail des développeurs par la même occasion. Aujourd’hui, ce sont près de 30 000 utilisateurs qui se servent d’AutoML d’après Rajen Sheth, responsable produit IA chez Google Cloud. Il compte aussi 2 millions de data-scientists sur la plateforme Kaggle, rachetée en 2017, alors que le nombre de développeurs dans le monde est dix fois supérieur.

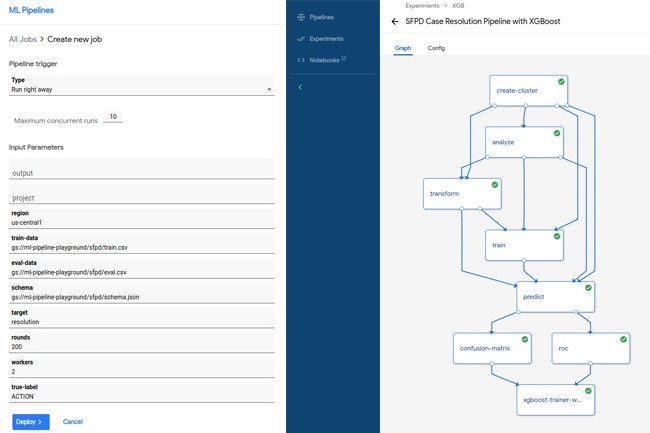

Alors 15 000 personnes utilisent aujourd’hui les services IA de Google, ce dernier souhaite continuer à faciliter le développement d’applications basées sur l’IA. Et lance aujourd’hui deux services dans cette optique. Le premier se nomme Kubeflow Pipelines. Fondé sur le projet open source Kubeflow, cet outil est une plateforme où le développeur va pouvoir composer, déployer et gérer des charges de travail d’apprentissage automatique de bout en bout. Ces dernières peuvent être ainsi utilisables par n’importe qui en interne. Kubeflow Pipelines va permettre également une expérimentation plus rapide pour tester différentes techniques de machine learning et identifier celle fonctionnant au mieux pour une application donnée. La plateforme est disponible sur GitHub.

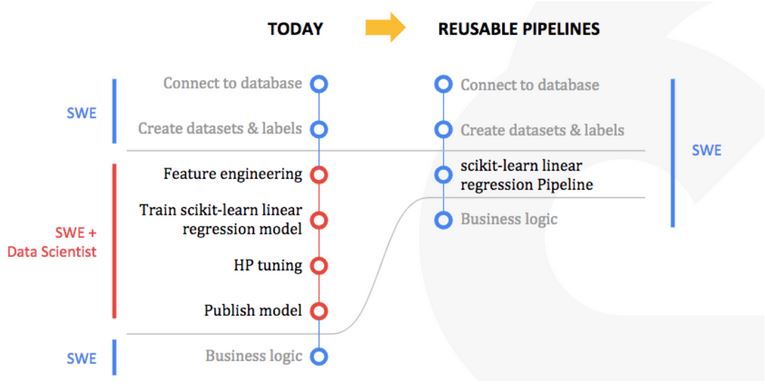

Les actions qui nécessitaient l'intervention d'un data scientist auparavant pourront être exécutées par les ingénieurs logiciels dans les pipelines. (Crédit : Google)

Un GitHub du machine learning

En parlant de cette plateforme de partage de code, il semble que Google ait voulu proposer le même genre de service pour les applications utilisant du machine learning (ML). Aujourd'hui disponible en version alpha, AI Hub a pour vocation de partager tout type de contenu ML prêt à l’emploi : de Jupyter Notebook aux modules TensorFlow, etc. D’une part, cette plateforme va permettre à Google de rendre publiques ses ressources ML développées par ses équipes Cloud IA, Research et autres. D’autres part, un hub privé peut être créer pour partager les ressources autour de l’apprentissage automatique en interne. Ceci pour, par exemple, faciliter les déploiements et la réutilisation des pipelines sur Google Cloud Platform ou d’autres infrastructures utilisant Kubeflow Pipeline.

Commentaire