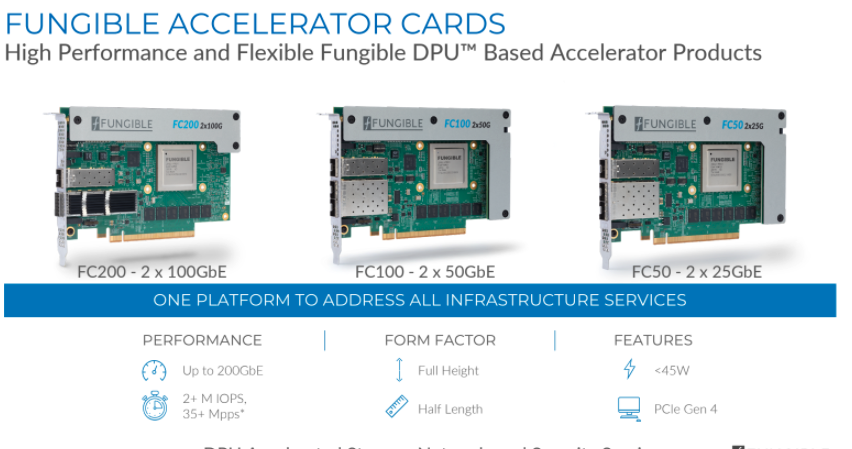

Pour augmenter les performances des systèmes de stockage dans les environnements de type calcul IA distribué, apprentissage machine et autres charges de travail transactionnelles aujourd’hui limités par les solutions avec de simples contrôleurs x86, Fungible a développé son propre DPU (unité de traitement des données) pour accélérer le traitement des requêtes NVMe/TCP. Créée en 2015 à Santa Clara par des anciens d’Apple et Juniper, cette start-up a été une des premières à utiliser le terme DPU pour décrire une carte accélératrice capable de décharger le processeur du système hôte de la gestion du trafic d’E/S. Baptisés F1 FC (50, 100 et 200), ces accélérateurs reposent sur des puces Mips64 R6 avec 52 cœurs et 64 lignes PCIe 3.0 pour gérer les charges de travail centrées sur les données (transfert, compression, sécurité, filtrage et analyse des données). Toutes les fonctions que les processeurs à usage général font généralement moins bien.

Une carte Fungible S1 assure 2 millions d'IOPS, ce qui fait un total de 10 sur une baie maison FS1600 avec cinq DPU, de type 2U avec 24 emplacements pour SSD NVMe. Scale-out, la FS1600 travaille en mode bloc et vient marcher sur les plates-bandes de la SFA18K de DDN, la PowerMax 2000 de Dell, la FlashArray//X m70 de Pure Storage, et plus sûrement la solution HyperParallel Flash Array (HFA) de Pavilion Data (bloc, fichier et objet).

Les cartes DPU de Fungible sont disponibles avec plusieurs types de lien. (Crédit Fungible)

Fungible n’est toutefois pas le seul à suivre cette voie. Le français Kalray fait de même avec son processeur MPPA Coolidge retenu par le fournisseur de baies de stockage Viking. Baptisée Flashbox, cette solution combine le châssis VDS2249R du second et la carte accélératrice K200-LP du premier. Autre initiative, celle du britannique Bamboo Systems dont les châssis B1000N reposant sur des puces ARM. Citons enfin, le taïwanais Graid qui exploite des GPU Nvidia sur sa carte SupremeRAID pour gérer des lecteurs NVMe sur un serveur Gigabyte R282-Z9G avec deux puces AMD Epyc.

Commentaire