Il vous reste 95% de l'article à lire

Vous devez posséder un compte pour poursuivre la lecture

Vous avez déjà un compte? Connectez-vous

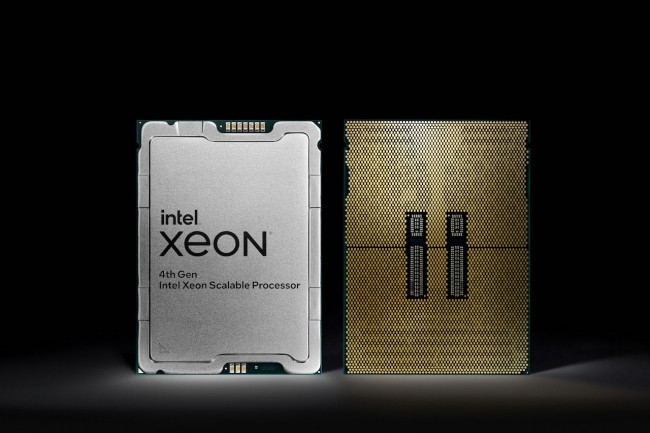

Attendues depuis plusieurs mois, les puces Xeon Sapphire Rapids d'Intel arrivent avec quatre jeux d'instructions supplémentaires verrouillés qui pourront être activés moyennant finance.

Il vous reste 95% de l'article à lire

Vous devez posséder un compte pour poursuivre la lecture

Recevez notre newsletter comme plus de 50000 abonnés

Commentaire