Selon un article du Financial Times, Amazon aurait convoqué en début de semaine une réunion d'ingénieurs afin de discuter d'une « série de pannes » liées à l'utilisation d'outils IA. D’après une note d'information à laquelle a eu accès le quotidien, la société a déclaré que ces derniers mois avaient été marqués par une « série d’incidents », dont « l’impact a été assez large » et caractérisés par des « changements assistés par l'IA générative ». Sous la rubrique « facteurs contributifs », la note mentionnait « l'utilisation novatrice de l'IA générative pour laquelle les meilleures pratiques et les mesures de protection ne sont pas encore pleinement établies. » L'article cite Dave Treadwell, vice-président senior du groupe d'ingénierie d'Amazon, qui aurait demandé que « les développeurs juniors et intermédiaires fassent désormais approuver toute modification assistée par l'IA par des développeurs plus expérimentés. »

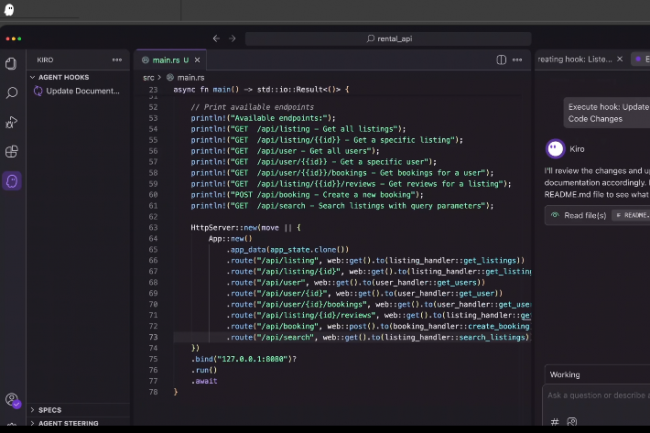

Cependant, selon Chirag Mehta, analyste principal chez Constellation Research, l'idée de faire approuver les modifications par des ingénieurs seniors pourrait involontairement annuler le principal avantage de la stratégie IA : l'efficacité. « Si chaque modification assistée par l'IA nécessite désormais qu'un développeur senior examine les différences, l'entreprise perd une grande partie du gain de vitesse qu'elle recherchait au départ », souligne-t-il. Tout en ajoutant, « la véritable solution consiste à déplacer la révision en amont et à la rendre obligatoire : vérification des politiques avant le déploiement, des contrôles plus stricts du rayon d'action pour les services à haut risque, une stratégie de déploiement Canary obligatoire, un retour en arrière automatique et une traçabilité plus forte afin que les équipes sachent toujours quelles modifications ont été assistées par l'IA, qui les a approuvées et quels comportements de production ont changé par la suite. » L'exigence d'approbations fait suite à plusieurs incidents liés à l'IA qui ont paralysé les services Amazon et AWS, notamment une panne du site e-commerce qui a duré près de six heures au début du mois et une interruption de 13 heures d'un service AWS en décembre. Le fournisseur avait alors démenti que les incidents soient liés à l’agent Kiro et évoquait une erreur humaine de configuration. Selon The Register, l’entreprise reste sur cette appréciation malgré les informations du Financial Times.

Des dysfonctionnements inévitables

Selon les analystes et les consultants, il n'est guère surprenant que des entreprises telles qu'Amazon découvrent que les systèmes non déterministes déployés à grande échelle créent des problèmes. L'intervention humaine est une bonne approche, mais il faut disposer d'un nombre suffisant de personnes pour gérer de manière raisonnable l'ampleur considérable du déploiement. Dans le domaine de la santé, par exemple, demander à une personne d'approuver 20 000 résultats de tests pendant une grande partie de son temps de travail ne constitue pas un contrôle significatif. Cela revient plutôt à faire porter à cette personne la responsabilité des erreurs inévitables liées aux tests. Yuri Goryunov, DSI chez Acceligence (société de conseil), fait remarquer que ce type de problèmes est toujours inévitable. « Pour moi, il s'agit là de difficultés normales liées à la croissance et d'étapes naturelles qui vont de pair avec l'introduction d'une technologie relativement nouvelle dans les workflows établis. Les avantages en termes de productivité et de qualité sont immédiats et impressionnants », a fait valoir M. Goryunov. « Cependant, certaines anomalies totalement inconnues doivent être étudiées, comprises et corrigées. Tant que les gains de productivité dépassent le travail de correction et de validation requis dans le cadre des paramètres convenus, tout ira bien. Sinon, il faudra revenir aux méthodes traditionnelles pour cette application particulière. »

Une stratégie « imprudente »

Nader Henein, vice-président analyste chez Gartner, pense pour sa part que le problème va s'aggraver. « Ce type d'incident continuera à se produire de plus en plus fréquemment. Le fait est que la plupart des entreprises pensent pouvoir intégrer des capacités assistées par l'IA de la même manière qu'elles peuvent intégrer un nouvel employé, sans modifier la structure environnante », s’est étonné M. Henein. « Lorsque nous confions une tâche et un ensemble de règles à un système IA, nous pouvons penser que tout est sous contrôle. Mais en réalité, l'IA fera tout ce qu'il faut pour atteindre son objectif dans le cadre de ces règles, même si cela implique de trouver des failles créatives et parfois alarmantes. Ce n'est pas que l'IA soit malveillante. C'est simplement qu'elle s'en moque. Elle n'a pas les limites, l'empathie ou l'intuition que la plupart des gens développent au fil du temps. »

C’est pour cette raison que Flavio Villanustre, responsable de la sécurité des systèmes d'information chez LexisNexis Risk Solutions Group, qualifie d’« imprudente », la stratégie typique des entreprises en matière d'IA. « On pourrait considérer le système IA comme une sorte d'enfant prodige doté d'un sens de la sécurité limité et imprévisible, auquel on donne accès à des tâches susceptibles de causer des dommages importants, dans l'espoir d'améliorer les performances et/ou de réduire les coûts. Cela s'apparente à de l'imprudence », a estimé M. Villanustre. « Au minimum, si l’on procède de manière traditionnelle, on testera d’abord le système dans un environnement de test indépendant, on vérifieria les résultats, puis on migrera les actions vers l'environnement de production », a-t-il noté. « Même si l'ajout d'un humain dans la boucle peut ralentir les choses et réduire quelque peu les avantages de l'utilisation de l'IA, c'est la bonne façon d'appliquer cette technologie aujourd'hui. »

Commentaire