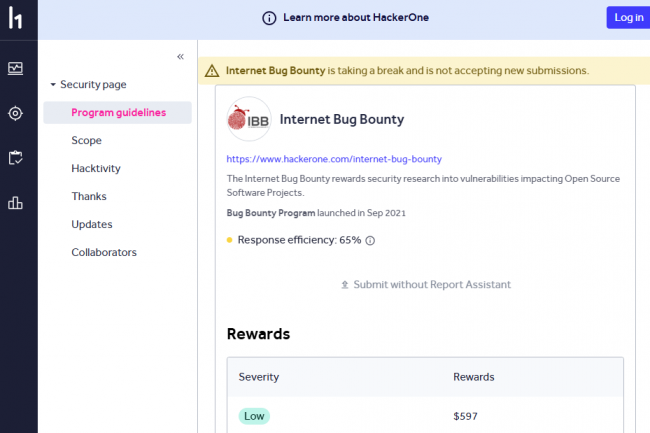

Les chercheurs qui identifient et signalent des failles dans des logiciels open source ne seront plus récompensés par le programme Internet Bug Bounty de HackerOne. La plateforme de chasse aux bugs a déclaré qu'il « suspendait les soumissions » le temps de réfléchir à des moyens de gérer plus efficacement la sécurité des logiciels open source. Ce programme, financé par plusieurs grandes entreprises de logiciels, existe depuis 2012 et a versé plus de 1,5 M$ aux chercheurs ayant signalé des bogues (entre 750 et 1 000$). Jusqu’à présent, 80 % des récompenses ont été attribuées pour la découverte de nouvelles failles, et 20 % pour soutenir les efforts de correction.

Mais l’intelligence artificielle facilite la détection des bogues et compromet l'équilibre de ce type de plateforme qui doit changer a indiqué HackerOne. « La recherche assistée par l'IA élargit la détection des vulnérabilités à l'ensemble de l'écosystème, améliorant à la fois la couverture et la rapidité. L'équilibre entre les découvertes et la capacité de correction dans l'open source a considérablement changé », a fait savoir la société. « Nous restons déterminés à renforcer la sécurité de l'open source. En collaboration avec les responsables de projets et les chercheurs, nous évaluons activement des solutions visant à mieux adapter les incitations aux réalités de l'écosystème open source et à garantir que la découverte de vulnérabilités se traduise par des mesures correctives durables. »

L'écosystème bug bounty s'adapte à l'IA

Node.js, une plateforme JavaScript côté serveur pour les applications web connue pour son écosystème étendu, a aussi du s'adapter à ce contexte de chasse aux bugs appuyée par l'IA. Bien que l'équipe du projet continue d'accepter et de trier les rapports de bogues via HackerOne, elle ne versera plus de récompenses sans le financement du programme Internet Bug Bounty, a expliqué la société. Le programme de HackerOne n'est pas le seul projet de chasse aux bogues à avoir rencontré des difficultés face à l'arrivée de l'IA dans la recherche de vulnérabilités. En janvier, le projet Curl a expliqué qu'il n'acceptait plus de signalements, pointant le fait d'être submergé par des rapports de signalement de failles générés avec l'IA.

Il n'est pas le seul. Google a aussi mis un terme le mois dernier aux signalements générés par l'IA dans le cadre de son programme de récompense pour la découverte de vulnérabilités dans les logiciels open source. « Nous observons de plus en plus souvent des rapports générés par l'IA contenant des informations erronées ou des hallucinations sur la manière dont une vulnérabilité pourrait être exploitée, ainsi qu'un afflux de rapports qui, bien que techniquement valides dans la mesure où ils signalent une erreur de codage telle qu'un débordement de tampon, ont un impact négligeable sur la sécurité compte tenu du modèle de sécurité du projet ou ne se trouvent pas dans des chemins d'exécution accessibles », a expliqué le fournisseur.

Commentaire