Anthropic a accusé trois développeurs chinois d'IA d'avoir mené des campagnes à grande échelle pour exploiter illicitement les capacités de son modèle Claude afin d'améliorer leurs propres systèmes. L’entreprise assure que DeepSeek, Moonshot et MiniMax ont utilisé une technique de distillation, dans laquelle un modèle moins performant est entraîné à partir des résultats d'un modèle plus avancé. Plus de 16 millions d'interactions ont été générées avec Claude via environ 24 000 comptes frauduleux, en violation des conditions d'utilisation et des restrictions d'accès régionales du fournisseur. Anthropic a rappelé qu’elle n’offrait pas d'accès commercial à Claude en Chine, ni aux filiales de ces entreprises opérant en dehors du pays.

Les capacités de Claude extraites à grande échelle

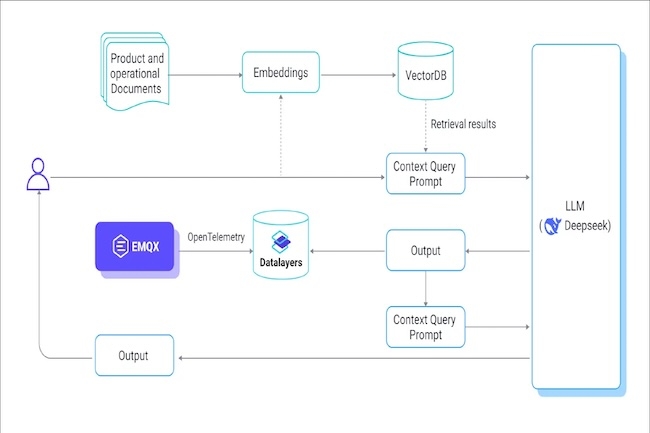

Selon Anthropic, les trois campagnes de distillation ont suivi un scénario similaire : elles ont utilisé des comptes frauduleux et des services proxy pour accéder à Claude à grande échelle tout en échappant à la détection, et elles ont ciblé les capacités de raisonnement, d'utilisation d'outils et de codage de Claude. La campagne DeepSeek a impliqué plus de 150 000 échanges, axés sur l'extraction de capacités de raisonnement dans diverses tâches. L'activité a généré un trafic synchronisé entre les comptes, avec des modèles identiques, des méthodes de paiement partagées et un timing coordonné suggérant un équilibrage de charge afin d'augmenter le débit, d'améliorer la fiabilité et d'éviter la détection. L'activité de Moonshot AI a impliqué plus de 3,4 millions d'échanges ciblant le raisonnement agentique et l'utilisation d'outils, le codage et l'analyse de données, le développement d'agents de calcul et la vision par ordinateur pour reconstruire les traces de raisonnement de Claude. MiniMax était la plus importante des trois, avec plus de 13 millions d'échanges, et visait directement le codage agentique, l'utilisation d'outils et l'orchestration. Détectée alors que la campagne était en cours, Anthropic a indiqué que MiniMax avait redirigé près de la moitié de son trafic vers le modèle nouvellement lancé de Claude en moins de 24 heures. Pour mener à bien ces campagnes, Anthropic a précisé que les entreprises s'étaient appuyées sur des services de proxy commerciaux qui revendent l'accès à Claude et à d'autres modèles d'IA de pointe à grande échelle, connus sous le nom d’architectures de clusters « hydra ».

Formation des modèles d'IA et données publiques

Les experts du secteur soulignent que ces allégations soulèvent une question plus large et non résolue sur la manière dont les LLM des systèmes IA sont formés. La plupart des grands modèles de langage, y compris les principaux systèmes commerciaux, sont eux-mêmes formés à partir de vastes quantités de données Internet accessibles au public, souvent sans le consentement explicite des auteurs originaux. « Tout comme bon nombre des modèles de fondation ont été construits en indexant l'immensité d'Internet, la plupart du temps sans le consentement explicite des créateurs ou en s'appuyant sur le contenu d'autres moteurs de recherche, les nouveaux entrants empruntent fréquemment les mêmes voies de distillation et d'optimisation », a déclaré Neil Shah, vice-président de Counterpoint Research. Il fait aussi remarquer qu'il existe un désaccord fondamental, qui n'est pour l'essentiel pas défini juridiquement, sur la question de savoir à qui appartiennent les données synthétiques et s'il est acceptable de les utiliser à des fins de formation, en particulier pour les modèles ouverts.

Contrôles à l'exportation et sécurité nationale

Anthropic a en partie présenté les campagnes de distillation présumées sous l'angle de la sécurité nationale, arguant que les modèles distillés illicitement pourraient compromettre les efforts des États-Unis pour contrôler la diffusion des capacités d'IA avancées, notamment s'ils sont orientés par le Parti communiste chinois. Cependant, les experts soulignent que les contrôles à l'exportation actuels des États-Unis se concentrent principalement sur le hardware et pas sur les grands modèles de langage. « Il est essentiel de séparer les restrictions matérielles de l'accès aux services. Les contrôles à l'exportation américains se sont essentiellement concentrés sur les semi-conducteurs avancés, les infrastructures IT haute performance et, à certains moments réglementaires, sur des catégories spécifiques de poids de modèles d'IA avancés. Il n'existe aucune interdiction universelle d'offrir un accès API à des grands modèles de langage en Chine », a expliqué Sanchit Vir Gogia, CEO et analyste en chef chez Greyhound Research.

Cependant, cela ne signifie pas que les développeurs sont à l'abri. M. Gogia a ajouté que le Bureau of Industry and Security continue d'affiner les conditions d'octroi de licences liées aux produits informatiques avancés et aux systèmes à haute capacité. De plus, si une entreprise soutient sciemment des activités de formation pour des entités soumises à des restrictions, en particulier celles liées à des objectifs militaires ou stratégiques, elle s'expose à des risques même sans expédier de matériel informatique. Pour se protéger, de nombreux fournisseurs américains d'IA limitent déjà la disponibilité de leurs produits en Chine par le biais de leur politique commerciale et de leur posture de conformité, allant même au-delà de ce qui est strictement requis. « Pour les développeurs, le risque est indirect mais réel : si le produit achemine l'accès vers des zones géographiques ou des entités soumises à des restrictions, facilite des utilisations finales interdites ou aide d'autres personnes à contourner les restrictions géographiques des fournisseurs, ils s’exposent à une résiliation de leur compte, une responsabilité contractuelle et éventuellement un contrôle réglementaire, selon l'identité de l'utilisateur final et les capacités du système », a pointé Amit Jaju, partenaire mondial/directeur général senior - Inde chez Ankura Consulting.

Implications pour les équipes qui développent des LLM

Pour les développeurs qui créent ou entraînent des modèles à l'aide de grands modèles de langages, les accusations d'Anthropic mettent en évidence une zone grise de plus en plus importante. Les développeurs utilisent couramment les API LLM pour le développement, le test ou l'évaluation d'applications. Mais les fournisseurs examinent de près l'utilisation automatisée à grande échelle des résultats des modèles pour entraîner des systèmes concurrents. Par exemple, Anthropic réagit en investissant dans des techniques défensives. Pour la détection, l'entreprise a mis au point plusieurs classificateurs et systèmes d'empreintes comportementales capables d’identifier les modèles d'attaques par distillation dans le trafic API. Elle a également renforcé la vérification des comptes de l’éducation, des programmes de recherche en sécurité et des start-ups, les citant comme les voies les plus couramment exploitées pour créer des comptes frauduleux. L'entreprise met aussi en place des mesures de protection au niveau des produits, des API et des modèles, de façon à réduire l'efficacité des résultats des modèles pour la distillation illicite, sans dégrader l'expérience des clients légitimes. Les développeurs doivent également s'assurer que la formation de leurs modèles reste sûre, conforme et défendable.

M. Jaju a déclaré que, pour commencer, les développeurs doivent examiner les conditions d'utilisation des API/services et ne pas supposer qu'ils peuvent former les modèles sur les résultats, sauf autorisation expresse. Ils doivent conserver une trace claire de la provenance de chaque élément de formation/exemple, avec les licences/conditions associées. Des journaux opérationnels distincts des ensembles de données de formation doivent être conservés, avec des limites de conservation définies. « La diligence géopolitique ne peut pas être examinée après coup. La vérification des parties soumises à des restrictions, les contrôles de conformité des exportations et les contrôles d'accès spécifiques à chaque région font de plus en plus partie de la gouvernance de l'IA, en particulier pour les entreprises opérant au-delà des frontières », a ajouté M. Gogia. Les experts affirment que si un organisme de réglementation ou un acquéreur leur demande d'expliquer le processus de formation, les développeurs devraient être en mesure de fournir les informations demandées avec des documents justificatifs et sans réserve.

Commentaire