En février 2025, le Financial Times annonçait qu’Arm allait commercialiser ses propres puces et évoquait la date de l’été 2025 pour les annonces. C’est finalement hier que le fournisseur a levé le voile sur son propre processeur pour datacenter et les charges de travail IA. Un changement de positionnement pour la société contrôlée par le japonais Softbank qui jusqu’alors licenciait simplement le design de ses puces, que des clients comme Qualcomm ou Nvidia intégraient avant de se tourner vers un fondeur comme TSMC pour la fabrication.

Une puce avec 136 cœurs Neoverse v3

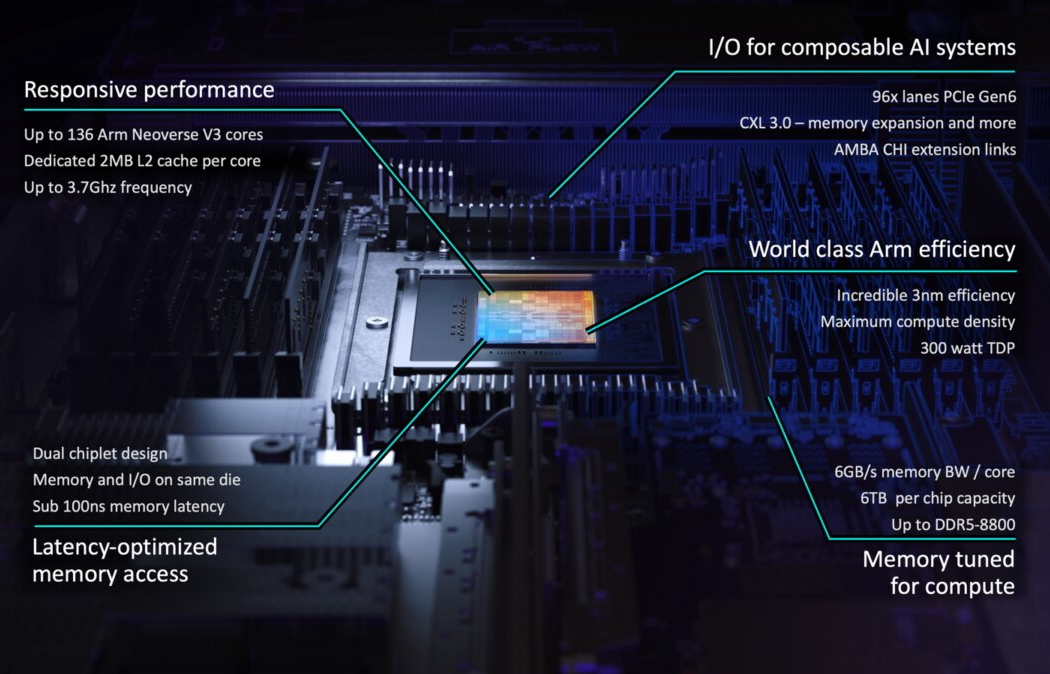

Baptisée AGI pour Artificial General Intelligence, la puce comprend 136 cœurs Neoverse v3 cadencés à 3,2 GHz pouvant monter à 3,7 GHz en mode turbo et affiche un TDP de 300 watt. Ils sont répartis sur deux dies gravés en 3 nm par TSMC. Le processeur intègre 2 Mo de cache L2 par cœur et 128 Mo de cache système partagé (SLC). Il prend en charge 12 canaux de mémoire DDR5 jusqu'à 8 800 MT/s, offrant une bande passante mémoire agrégée de plus de 800 Go/s, soit 6 Go/s par cœur, avec une latence inférieure à 100 ns. L'interface d'E/S comprend 96 lignes PCIe Gen6 et la prise en charge native de CXL 3.0 pour l'extension et le regroupement de la mémoire.

Les premières spécifications de la puce AGI annoncées par Arm. (crédit : Arm)

Pour accompagner ce lancement, Arm a validé deux reference design de racks basés sur les standards Open Compute. Le premier, dual node de 36 kW et refroidi par air, est équipé de 30 serveurs (1U dual node) atteignant un total de 8 160 cœurs par rack. Le second est conçu en partenariat avec Supermicro, atteint 200 kW avec du refroidissement liquide. Il peut accueillir jusqu’à 45 696 cœurs répartis dans 42 serveurs (8 noeuds). Avec ces configurations, la société revendique des performances par rack plus de deux fois supérieures à celles des dernières plateformes x86. Outre Supermicro, Arm a travaillé avec ASRockRack et Lenovo pour commercialiser différentes configurations de serveurs embarquant la puce AGI au deuxième semestre 2026.

Plusieurs clients validés

Dans un communiqué, le fournisseur indique que son processeur est conçu « pour supporter des charges de travail multi-agents massivement parallèles et à hautes performances dans un déploiement de racks à forte densité ». Depuis quelques mois, l’engouement pour les agents OpenClaw a remis en avant les besoins de CPU pour le traitement agentique en local. Nvidia l’a bien compris en se positionnant sur ce sujet avec NemoClaw mais aussi sa puce Vera.

La puce AGI d’Arm entend bien trouver sa place dans ce domaine avec comme premier client Meta. Ce dernier va s’en servir pour épauler les derniers accélérateurs MTIA présentés récemment. La société dirigée par Mark Zuckerberg multiplie ses derniers mois les initiatives et les contrats pour accélérer dans l'IA. D’autres clients ont aussi décidé de tenter l’aventure avec Arm : OpenAI, SAP, Cerebras, Cloudflare, F5, SK Telecom et Rebellions (start-up fournissant un accélérateur IA). Il reste maintenant à savoir comment le marché va accueillir ce changement de stratégie du fournisseur britannique qui devient un concurrent de ses propres clients. En effet, plusieurs sociétés comme Nvidia, Qualcomm, Fujitsu, Texas Instruments, Marvell...proposent déjà des puces serveurs basées sur Arm.

Commentaire