Les capacités de génération de code par l’IA sont scrutées de près par les entreprises pour les gains de productivité. Et c’est tout naturellement que les acteurs de l’IA se sont emparés du sujet. Le dernier en date est Mistral, la start-up française vient en effet de présenter Codestral, un modèle de génération de code.

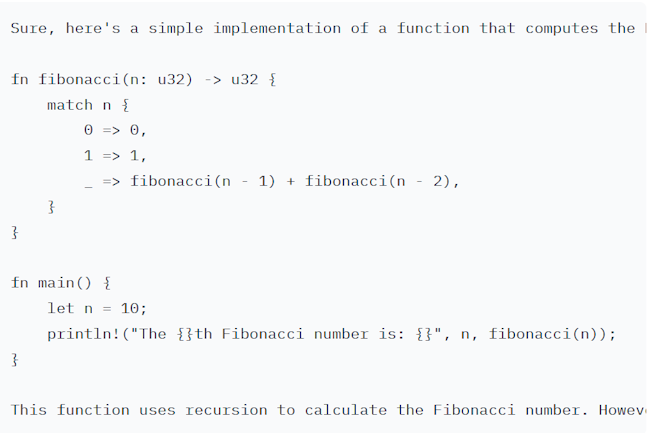

Dans un blog, la société explique que le modèle a été « entraîné sur un ensemble de données diversifié de plus de 80 langages de programmation, y compris les plus populaires, tels que Python, Java, C, C++, JavaScript et Bash. Il est également performant sur des langages plus spécifiques comme Swift et Fortran ». Codestral comprend 22 milliards de paramètres et affiche des fenêtres contextuelles de 32 000 tokens. Il est disponible sur Hugging Face, mais aussi sur la Plateforme et le Chat de Mistral, ou encore via une API. Il s'intègre par ailleurs dans VSCode et les environnements JetBrains.

Meilleur que CodeLLama et une licence particulière

Mistral a réalisé des benchmarks sur de la programmation en Python ou SQL de son modèle avec d’autres en particulier CodeLLama 70B de Meta (dont la fenêtre contextuelle ne comprend que 4 000 tokens). Les résultats tournent en faveur de Codestral, mais la start-up ne l’a pas confronté à d’autres modèles comme Gemini (ex Alphacode) de Google ou GPT d’OpenAI.

A noter que le modèle est proposé sous une forme de licence baptisée « Mistral AI non production license », réservant son usage aux chercheurs et pour des tests. La société détaille dans un blog cette approche qui propose, selon elle, « aux développeurs d'utiliser la technologie à des fins non commerciales et de soutenir les travaux de recherche ». Elle avait déjà succombé aux sirènes du propriétaires récemment en lançant son assistant Le Chat et son LLM Large.

Commentaire