Pour fournir des résultats plus fiables à une requête en langage naturelle dans une base de données, Oracle a dévoilé le service Trusted Answer Search qui s’appuie sur la recherche sémantique ou vectorielle. Cette approche se distingue du recours au LLM et au RAG (retrieval augmented generation) habituellement utilisés. « « Au lieu de récupérer du texte brut et de générer une réponse, comme c'est généralement le cas dans les systèmes RAG qui s'appuient sur des LLM, le système sous-jacent de Trusted Answer Search cartographie de manière déterministe la requête à un « document correspondant » spécifique, extrait tous les paramètres requis et renvoie un résultat structuré et vérifiable, tel qu'un rapport, une URL ou une action », indique Tirthankar Lahiri, vice-président senior chargé des données critiques et des moteurs IA chez Oracle.

Les utilisateurs peuvent également signaler les correspondances incorrectes et préciser le résultat attendu via une boucle de rétroaction. Selon le dirigeant, les entreprises ont de plus en plus besoin de systèmes de recherche en langage naturel plus déterministes, capables d’éliminer les réponses incohérentes et d’assurer la traçabilité à des fins de conformité. Le service est disponible en téléchargement ou accessible via des API et définit « un espace de recherche » organisé, composé de rapports, de documents ou de points de terminaison d’applications approuvées et associées à des métadonnées. Pour Tirthankar Lahiri, cette offre répond aux besoins des entreprises d’avoir des systèmes de recherche en langage naturel plus déterministes, capables d’éliminer les réponses incohérentes et d’assurer la traçabilité à des fins de conformité. David Linthicum, consultant indépendant, partage cet avis quant aux perspectives de marché de Trusted Answer Search. « Toute entreprise qui privilégie la prévisibilité à la créativité et souhaite réduire les risques opérationnels, en particulier dans les secteurs réglementés, tels que la finance et la santé, est un utilisateur potentiel de la solution », a-t-il reconnu.

Des compromis à prévoir

Robert Kramer, associé gérant chez KramerERP, estime que cette approche comporte des compromis que les DSI doivent prendre en compte. « Si Trusted Answer Search peut réduire les coûts d’inférence en évitant une utilisation intensive des grands modèles de langage (LLM), elle réoriente les dépenses vers la curation des données, la gouvernance et la maintenance continue », a-t-il fait remarquer. David Linthicum pense aussi que les entreprises qui adopteront cette technologie devront investir dans la curation des documents, la conception de la taxonomie, les validations, la gestion du changement et l’ajustement continu. Quant à Scott Bickley, analyste chez Info-Tech Research Group, il a mis en garde contre les défis liés au maintien à jour des données. « À mesure que le volume des données sources augmente pour inclure du contenu provenant de sources externes, comme les mises à jour réglementaires, les certifications des fournisseurs ou les actualités du marché, qui sont réactualisées plus fréquemment et dont le nombre de documents peut se chiffrer en milliers, le risque s’accroît », a-t-il déclaré.

« Le problème réside dans la capacité à fournir des réponses précises à partir d’un ensemble d’un grand volume de données, en particulier lorsque des documents peuvent se contredire d’une version à l’autre ou lorsque des formulations similaires prennent un sens différent dans des contextes réglementaires. Le risque de se voir proposer des résultats plausibles mais erronés augmente », a ajouté M. Bickley. M. Lahiri, d’Oracle, a cependant indiqué que certaines de ces préoccupations pourraient être atténuées par la manière dont Trusted Answer Search extrait le contenu. Selon le VP senior d’Oracle, plutôt que de s’appuyer uniquement sur de grands volumes de documents statiques et sélectionnés qui nécessitent une mise à jour constante, le système peut traiter les « documents fiables » comme des URL paramétrées qui extraient du contenu généré dynamiquement à partir des systèmes sous-jacents.

Une concurrence importante

Le dirigeant affirme qu’ainsi « le système peut générer des réponses à partir de sources de données en temps réel telles que des applications d’entreprise, des API ou des points de terminaison Web régulièrement mis à jour, ce qui réduit la dépendance vis-à-vis des référentiels de documents gérés manuellement ». M. Linthicum n’est pas entièrement convaincu par cet argument. Il reconnait seulement que l’approche d’Oracle pourrait contribuer à réduire le renouvellement du contenu. « Dans les domaines en constante évolution, maintenir à jour les descriptions, les synonymes et les mappages nécessite toujours des responsables rigoureux, des validations et un examen des feedbacks. Le système peut s’étendre à des milliers de cibles, mais les chevauchements sémantiques augmentent la complexité de la maintenance », a-t-il souligné.

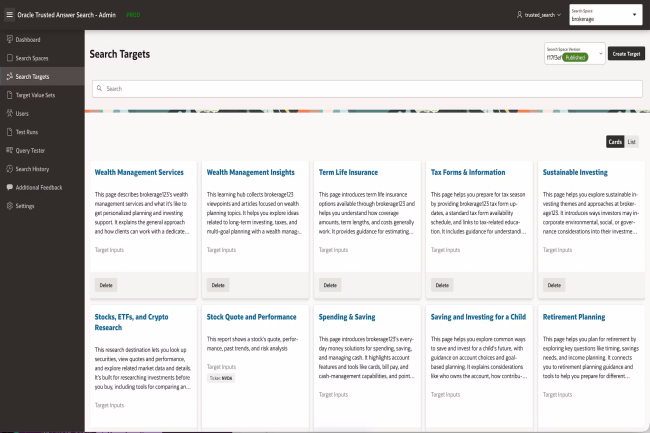

Avec Trusted Answer Search, Oracle se retrouve en concurrence avec les offres d’autres hyperscalers. Des produits tels qu’Amazon Kendra, Azure AI Search, Vertex AI Search et IBM Watson Discovery prennent déjà en charge la recherche sémantique sur les données d’entreprise, souvent associée à des contrôles d’accès et à des techniques de recherche hybrides. Selon Ashish Chaturvedi, responsable de la recherche exécutive chez HFS Research, il y a une distinction essentielle entre ces offres et celle d'Oracle, à savoir que les produits concurrents intègrent généralement des capacités IA générative pour produire des réponses. Les entreprises peuvent évaluer l’offre Trusted Answer Search en téléchargeant un package comprenant des composants tels que la recherche vectorielle, un modèle d'intégration pour traiter les requêtes des utilisateurs et des API pour l'intégration dans les applications et interfaces utilisateur existantes. Elles peuvent également l'exécuter via des API ou des applications GUI intégrées, incluses dans le package sous la forme de deux applications basées sur l’architecture APEX d’Oracle : une interface d'administration pour gérer le système et un portail pour les utilisateurs finaux.

Commentaire