A l’occasion de la GTC 2026 qui se déroule à San José du 16 au 19 mars, Cisco et Nvidia ont poursuivi leur travail commun pour mettre en place l’infrastructure nécessaire pour déployer et sécuriser l’IA à grande échelle. Ils ont annoncé une extension de l’architecture unifiée Secure AI Factory présentée en mars 2025 et qui a déjà subi des évolutions en décembre dernier. Rappelons que ce système combine la technologie sécurité et réseau de Cisco, les DPU et le logiciel AI Enterprise de Nvidia ainsi que des options de stockage multifournisseurs.

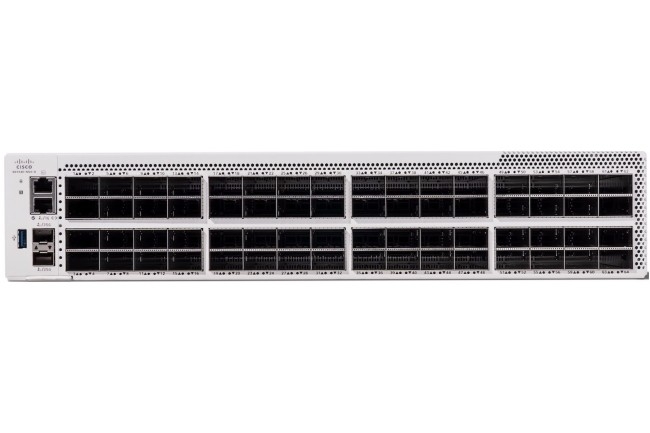

Aujourd’hui, la gamme s’enrichit des derniers commutateurs N9100 équipés de la puce Silicon One G300 présentée lors du dernier Cisco Live et capable d'atteindre un débit de 102,4 Tbps. Ils embarquent aussi l’accélérateur Ethernet Spectrum-6 de Nvidia en complément des switchs N9100 800G intégrant la puce Ethernet Spectrum 4 déjà disponible. Ils peuvent être déployés au sein des architectures de référence conforme à Nvidia Cloud Partner ou celles de Cisco Cloud à destination des neocloud provider ou des autres fournisseurs de services cloud. En fonction de leur besoin les clients peuvent choisir entre les différents OS réseau à savoir NX-OS de Cisco ou le système d’exploitation open source Sonic. « L’objectif est de fournir une infrastructure réseau à une grande variété de clients » explique Kevin Wollenweber, vice-président senior et directeur général de la division Centres de données et infrastructures Internet chez Cisco. Il ajoute qu’ « ils pourront s’appuyer sur Nexus Hyperfabric intégrer à Nexus One [plateforme de gestion des commutateurs] pour intégrer plus facilement l’IA ». Ce service automatise le déploiement et l’exploitation de l’infrastructure, notamment les clusters de GPU, les réseaux, la télémétrie et les systèmes de stockage. « Les clients peuvent désormais contrôler et gérer cet environnement et l'exploiter comme s'il s'agissait d'une structure de centre de données traditionnelle » ajoute le dirigeant. Il précise par ailleurs que « la possibilité de tout regrouper sous la même enseigne Nexus est en réalité un argument de vente majeur pour les clients de l’IA, car leurs équipes IT et opérationnelles chargées de faire fonctionner le réseau savent déjà comment utiliser ces outils Nexus »

Intégration de la technologie Hybrid Mesh Firewall

Côté sécurité, l'équipementier a annoncé qu'il intégrerait sa technologie Hybrid Mesh Firewall, annoncé aussi au Cisco Live, afin d’appliquer des politiques de sécurité sur les DPU BlueField de Nvidia intégrés aux serveurs GPU DGX connectés aux équipements gérés par Nexus One. « La technologie Hybrid Mesh Firewall offre une structure de sécurité distribuée dotée d'un cadre de sécurité « zero trust » intégré au réseau pour la segmentation, la protection des applications IA et la sécurité avancée contre les menaces », a souligné Cisco. « L'idée est de bloquer les menaces au niveau du serveur avant qu'elles n'atteignent les données d'une entreprise », a précisé M. Wollenweber. Les clients peuvent protéger les charges de travail IA en micro-segmentant ces systèmes et en offrant une sécurité au niveau des applications.

Les deux entreprises étendent également AI Defense en y intégrant la prise en charge de NeMo Guardrails de Nvidia, qui fait partie de la suite logicielle globale AI Enterprise du fournisseur. Avec les garde-fous, les développeurs peuvent contrôler le comportement des LLM. Dans ce contexte, Cisco et Nvidia ont indiqué vouloir orienter cette solution vers l'aide apportée aux clients pour contrôler le comportement des agents IA. « AI Defense prendra en charge et sécurisera la dernière plateforme de développement d'agents ouverte de Nvidia, OpenShell, en ajoutant des contrôles et des garde-fous pour régir les actions des agents IA et des openclaws (des agents IA autonomes), a indiqué Cisco. [Les les openclaws étant des agents IA qui fonctionnent directement sur l'ordinateur d'un utilisateur et effectuent des tâches complexes sans supervision humaine constante]. Enfin, Cisco a annoncé le support du serveur RTX Pro 4500 Blackwell de Nvidia à son portefeuille UCS et à son offre Unified Edge. L'idée est que les clients UCS puissent ajouter des GPU directement dans les serveurs UCS déjà déployés dans les centres de données.

Commentaire