Plus qu’une tendance, l’IA et la GenAI se diffusent rapidement en entreprise. Cette vitesse inquiète les RSSI qui ont du mal à appliquer des règles de sécurité et à contrôler cette technologie. Pour répondre à cette demande, Cisco vient de présenter la solution AI Defense. Selon Tom Gillis, vice-président senior et directeur général de Cisco Security, l’intégration des fonctions d’IA progresse à un rythme que les équipes de sécurité ne parviennent pas à suivre, créant de nombreuses vulnérabilités que les attaquants peuvent exploiter. Il pointe du doigt le fait que l’adoption des outils IA offre « un vaste éventail d’options pour les équipes de développement, tandis que celles de sécurité chargées d'établir des limites autour du travail des développeurs, peinent à suivre et perdent souvent le fil ».

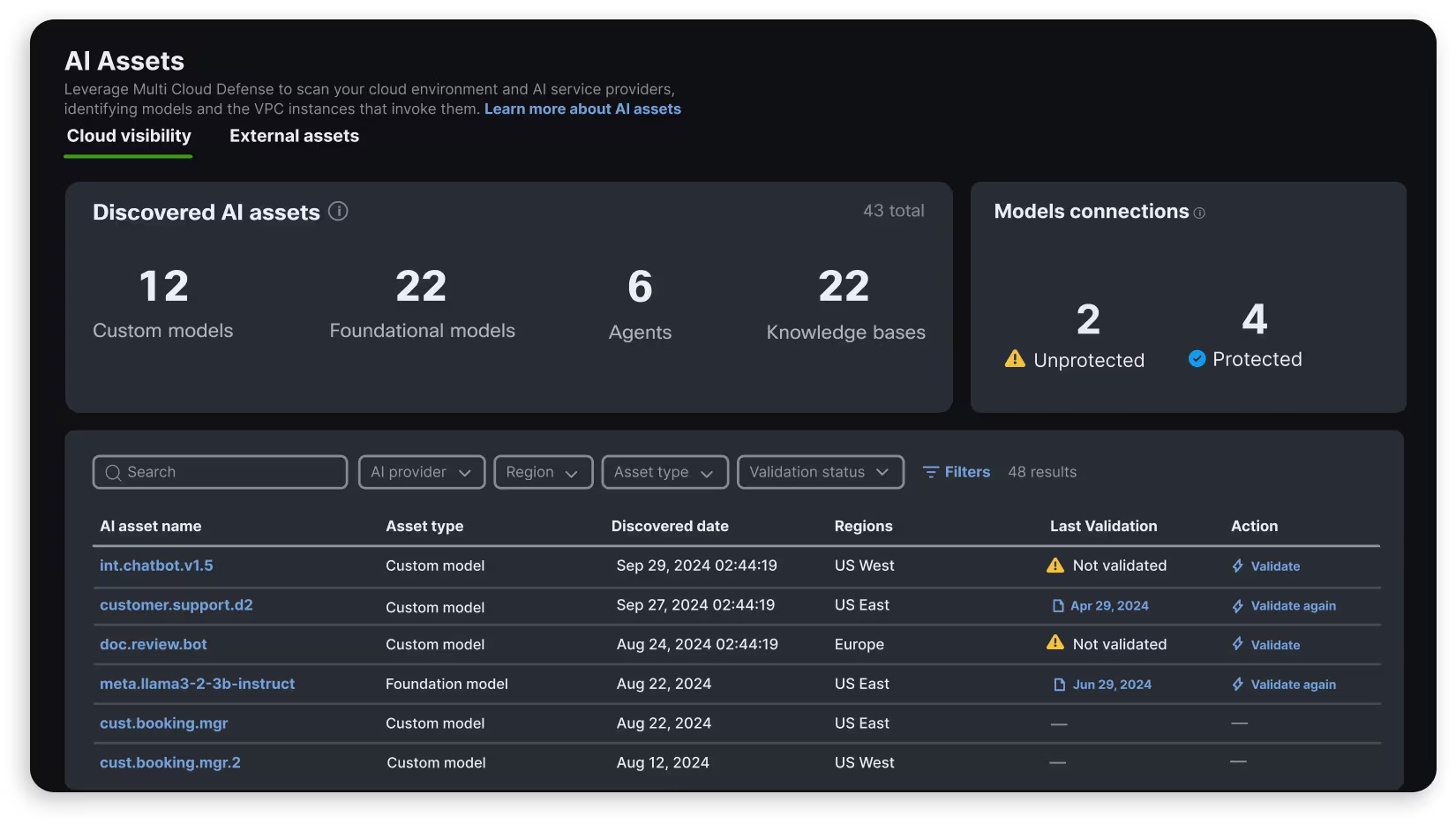

AI Defense se propose donc dans un premier temps de mener un inventaire avec le module Discovery de toutes les charges de travail de l'IA, des applications, des modèles, des données et de l'accès des utilisateurs à travers les environnements cloud. La solution s’intègre aux outils de monitoring réseau (pare-feux, les proxies web et des gateways sécurisés) pour analyser le trafic réseau et identifier tous les flux de travail d’IA existants.

AI Defense propose une fonction d'inventaire des assets en matière d'IA. (Crédit Photo : Cisco)

Une évaluation des modèles par l’IA de Cisco

AI Defense tente également de répondre à un deuxième problème : la nécessité de modifier les pratiques de sécurité à mesure que les systèmes infusés par l'IA se généralisent. « La spécificité de l'IA, c'est que son architecture est tout simplement différente », observe Tom Gillis. « Une application traditionnelle comporte trois couches : la couche de présentation (couche web), la logique d'application et la couche de persistance des données. Les données se trouvent dans la couche de persistance, qui, par définition, est persistante, tandis que la couche intermédiaire ne conserve aucune donnée », a-t-il expliqué.

L'IA ajoute un modèle au milieu, dans lequel sont absorbées les données. « Le modèle conserve et transforme les données, ce qui crée une couche tout à fait nouvelle dans la pile qui nécessite une attention et une protection particulières. » Pour relever ce défi, AI Defense offrira une capacité de détection alimentée par l’IA de Cisco. Elle effectuera une « validation de modèle » par le biais de tests exhaustifs de la logique du modèle afin d'identifier tout signe de compromission ou d'empoisonnement. « L’idée est de s’assurer que les données utilisées pour la formation sont exactes et valides, sans ajouts malveillants aux ensembles de données », a fait valoir M. Gillis. « De plus, il vérifiera que les garde-fous mis en œuvre dans le modèle fonctionnent correctement et que le modèle se comporte comme prévu. »

Protection au moment de l'exécution

Si AI Defense définit des garde-fous pour les modèles d'IA, il donne la capacité aux équipes de sécurité de mettre en œuvre ces protections de manière indépendante, sans interférer avec le contrôle des modèles par les développeurs. « La solution est capable de calibrer et de définir dynamiquement des garde-fous pour les modèles avant et pendant la production », a poursuivi le dirigeant de Cisco Security. Il ajoute, « en production, un système de surveillance observe le comportement normal de l'application et détecte les anomalies, en particulier les attaques par injection de prompt, en signalant les actions qui s’éloignent des schémas prévus. » Tom Gillis précise que cette protection en cours d'exécution est indépendante et transparente par rapport au modèle d'IA et vit entièrement dans le « réseau ».

Tom Gillis fait encore remarquer que la plupart des outils concurrents de sécurité de l'IA se concentrent principalement sur la surveillance de l'échange de données et la prévention des pertes de données (DLP), leur phase de découverte se limitant généralement à l'identification directe des éléments d'IA existants. « Avec AI Defense, la différence essentielle réside dans la compréhension de l'application », a-t-il déclaré. « Contrairement à d'autres outils de sécurité de l'IA, AI Defense procède à la validation du modèle et il a la capacité d'appliquer des protections, telles que la prévention des attaques par injection de prompt au moment de l'exécution. Nos modèles propriétaires suivent de manière unique le comportement de l'application et surveillent toute dérive. » Outre l'injection de prompt, la solution vise à protéger contre les attaques par empoisonnement de données et de modèles. Elle sera généralement disponible d'ici la fin du mois de février via le Cisco Security Cloud.

Commentaire