Face à des pénuries de composants, les entreprises IT travaillent pour optimiser les modèles IA et les rendre moins gourmands en ressources. Dans ce cadre, Google a dévoilé TurboQuant, un algorithme de compression de la mémoire cache des LLM. Testé sur les modèles Gemma et Mistral, il fait ressortir des économies de mémoire significatives et un temps d’exécution plus rapide, sans perte de précision mesurable. Le fournisseur a notamment observé une réduction de 6 fois de l'utilisation de la mémoire et une accélération de 8 fois du calcul de l'algorithme logit d'attention sur le matériel Nvidia H100.

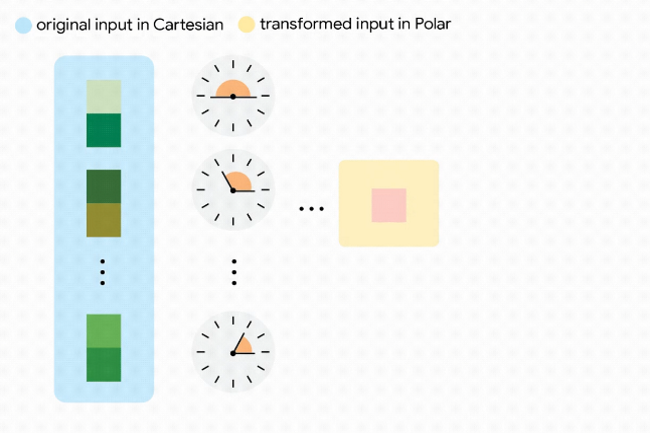

Selon le fournisseur, TurboQuant cible deux des composants les plus coûteux des systèmes IA : le cache clé-valeur (KV) utilisé lors de l'inférence LLM et les opérations de recherche vectorielle qui sous-tendent de nombreuses applications de récupération d'informations. En compressant plus efficacement ces charges de travail sans altérer la qualité des résultats, l’algorithme pourrait permettre aux développeurs d'exécuter davantage de tâches d'inférence sur le matériel existant et d'alléger la pression sur les coûts liés au déploiement de modèles volumineux. Sur la partie compression, la société s'est appuyée sur la méthode PolarQuant. « Au lieu d'analyser un vecteur mémoire à l'aide de coordonnées standard (X, Y, Z) indiquant la distance le long de chaque axe, cette technique convertit le vecteur en coordonnées polaires à l'aide d'un système de coordonnées cartésiennes », explique la firme de Mountain View dans un blog. Avec à la clé, une surcharge mémoire éliminée.

Un déploiement en entreprise qui fait débat

La question de savoir si cela représente une avancée significative pour les équipes IA en entreprise dépendra des performances de la technique en dehors des tests internes de Google et de sa facilité d'intégration aux environnements logiciels de production. « Si ces résultats se confirment en production, l'impact sera direct et économique », a déclaré Biswajeet Mahapatra, analyste principal chez Forrester. Il ajoute, « les entreprises dont la capacité est limitée par la mémoire GPU plutôt que par la puissance de calcul pourraient exécuter des fenêtres de contexte plus longues sur le matériel existant, supporter une concurrence plus élevée par accélérateur ou réduire leurs dépenses totales en GPU pour une même charge de travail. »

Sanchir Vir Gogia, analyste en chef chez Greyhound Research est plus direct. « Google s'attaque à l'un des problèmes les plus agaçants et les moins abordés des systèmes IA actuels : la saturation de la mémoire lors de l'inférence. Dès que l'on dépasse les simples prompts et que l'on travaille avec de longs documents, des flux de travail complexes ou tout élément nécessitant la persistance du contexte, la mémoire devient la contrainte », précise-t-il. Une compression significative donnera aux développeurs la capacité de gérer directement des requêtes plus longues, des documents plus volumineux et une mémoire persistante plus importante pour les agents, sans avoir à repenser l'architecture sous-jacente. Cependant, l’analyste a averti que les gains d'efficacité ne se traduisent pas nécessairement par une baisse des dépenses. « Les gains d'efficacité réduisent rarement les dépenses, ils augmentent l'utilisation », constate-t-il.

Des multiples bénéfices

Google positionne TurboQuant comme un moyen susceptible d'améliorer à la fois l'inférence des LLM et la recherche vectorielle. Certains analystes estiment que les bénéfices les plus immédiats se feront probablement sentir au niveau du premier point. « Le problème du cache clé-valeur constitue déjà un frein majeur aux coûts et à l'évolutivité pour les entreprises déployant des solutions de chat, d'analyse de documents, d'assistants de codage et de flux de travail automatisés. TurboQuant compresse directement cette mémoire d'exécution sans réentraînement ni calibration », selon Biswajeet Mahapatra. « La recherche vectorielle bénéficie également des mêmes techniques de compression sous-jacentes, mais la plupart des entreprises gèrent déjà la mémoire vectorielle par le biais du partitionnement ou de la hiérarchisation du stockage, ce qui atténue l'impact immédiat. » Cette distinction est importante car la pression sur la mémoire d'inférence a tendance à frapper les entreprises là où elle est la plus critique : dimensionnement des GPU, latence et coût par requête. Autrement dit, le problème n'est pas théorique. Il affecte dès aujourd'hui l'économie du déploiement à grande échelle des systèmes IA.

Pour Sanchir Vir Gogia, l’impact pourrait d’abord bénéficier aux systèmes de recherche vectorielle. « Ils sont modulaires. On peut les isoler, les ajuster et les tester sans tout perturber ». Il note par ailleurs, que « leur fonctionnement à grande échelle repose déjà sur la compression. Toute amélioration à ce niveau a donc un impact immédiat. L'espace de stockage requis diminue, la reconstruction des index est plus rapide et les cycles d'actualisation sont améliorés. Il s'agit d'une valeur opérationnelle, et non théorique. » L’analyste souligne que l’annonce de Google représente une prouesse technique qui répond à un problème concret et pourrait apporter des avantages significatifs dans certains contextes. Il a toutefois ajouté que cela ne modifie pas les contraintes sous-jacentes, soulignant que les systèmes IA restent limités par l'infrastructure, la consommation d'énergie, le coût et la complexité de l'interopérabilité de tous les composants.

Commentaire