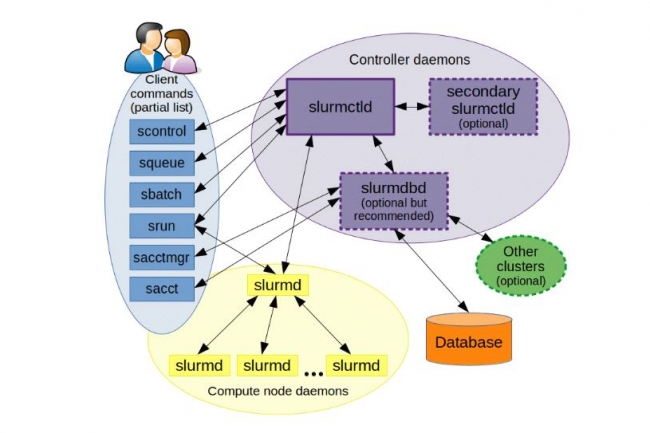

La récente acquisition par Nvidia de SchedMD, l’entreprise à l'origine du gestionnaire de charge de travail Slurm (Simple Linux Utility for Resource Management), inquiète les dirigeants du secteur de l'IA et les spécialistes du calcul intensif. Ces derniers craignent que le géant des puces n'utilise sa nouvelle position pour favoriser son propre matériel au détriment des puces concurrentes, soit par une priorisation du code, soit par des décisions relatives à la feuille de route. Telle que la formulent des sources du secteur, la préoccupation est simple : Nvidia contrôle dorénavant un logiciel de planification qui fonctionne également sur le matériel de ses concurrents, notamment AMD et Intel. « Qu’il l’exerce ou pas, un fournisseur qui contrôle un logiciel de planification des charges de travail dispose d’un levier important sur l’efficacité avec laquelle le matériel concurrent fonctionne au sein d’environnements IT partagés », a rapporté Reuters, citant cinq sources anonymes, dont trois travaillent dans le secteur de l’IA et deux ont des connaissances dans l’exploitation des supercalculateurs.

Selon les analystes interrogés par InfoWorld, si, lors de l'annonce de l'acquisition, la firme de Santa Clara a assuré qu’elle « continuerait à développer et à distribuer Slurm en tant que logiciel open source et indépendant des fournisseurs », l'engagement de Nvidia en faveur de l'open source pourrait ne pas constituer une protection suffisante. « La base open source de Slurm offre diverses garanties, en particulier un code transparent, la possibilité de créer des forks et une gouvernance communautaire, mais le contrôle exercé par SchedMD confère à Nvidia un pouvoir d’influence plutôt qu’un verrouillage technique », a déclaré Manish Rawat, analyste en semi-conducteurs chez TechInsights. « Nvidia pourrait subtilement orienter la feuille de route, en donnant la priorité à une planification tenant compte des GPU et à des optimisations topologiques favorisant son propre matériel », a-t-il ajouté. Il constate aussi que les calendriers d’intégration témoignent déjà d’un support plus rapide de l’écosystème Cuda par rapport à des alternatives comme ROCm d’AMD ou OneAPI d’Intel, créant ce qu’il appelle « un meilleur chemin de prise en charge ».

Importance de Slurm pour les supercalculateurs

Initialement développé au Lawrence Livermore National Laboratory, Slurm fonctionne sur environ 60 % des supercalculateurs du monde. « Le logiciel est activement utilisé par de grandes entreprises d'IA, notamment Meta Platforms, Mistral et Anthropic, pour certains aspects de l'entraînement des modèles d'IA », comme l’a indiqué Reuters. Les supercalculateurs gouvernementaux utilisés pour les prévisions météorologiques et la recherche dans la sécurité nationale en dépendent également. Nvidia a racheté SchedMD, le développeur de Slurm, en décembre 2025. À l’époque, le fournisseur avait déclaré que l’opération visait à renforcer son écosystème open source et à aider les utilisateurs à adopter de nouvelles techniques d’IA parallèlement aux tâches traditionnelles du calcul intensif.

Une inquiétude justifiée ?

Le Dr Danish Faruqui, CEO de Fab Economics, un cabinet de conseil américain spécialisé dans le matériel d'IA et les centres de données, estime que le risque est réel. « La possibilité que Nvidia donne la priorité à son propre matériel dans les futures mises à jour logicielles, et retarde ou limite ainsi l’optimisation de la prise en charge des produits concurrents, est un scénario plausible », a-t-il reconnu. « En tant que développeur principal, Nvidia contrôle désormais la feuille de route officielle de développement de Slurm et le processus de révision du code, ce qui pourrait influencer la rapidité avec laquelle les puces concurrentes sont intégrées aux nouveaux éléments de développement ou d’amélioration continue », a expliqué M. Faruqui. Le fait de contrôler le plan de contrôle ainsi que les GPU et l’infrastructure réseau telle qu’InfiniBand permet à Nvidia de créer une pile étroitement intégrée verticalement qui peut conduire à ce que M. Faruqui décrit comme « de légers écarts, où les fonctionnalités avancées ne sont disponibles ou performantes que sur le matériel Nvidia ». Selon les observateurs du secteur, pour vérifier concrètement cette hypothèse, il faudra comparer la rapidité avec laquelle Nvidia intègre la prise en charge des puces de nouvelle génération d’AMD dans le code source de Slurm à celle avec laquelle l’entreprise intègre ses propres technologies matérielles et réseau à venir, comme InfiniBand.

Le précédent de Bright Computing

Les analystes citent l’acquisition de Bright Computing par Nvidia en 2022 comme point de référence, affirmant que le logiciel a été optimisé pour les puces Nvidia d’une manière qui a désavantagé les utilisateurs de matériel concurrent. Nvidia a contesté cette interprétation, arguant que Bright Computing prend en charge « pratiquement tous les clusters accélérés par CPU ou GPU ». Pour M. Rawat, cette comparaison est instructive mais imparfaite. « L'acquisition de Bright Computing par Nvidia met en évidence sa préférence pour l'intégration verticale, en intégrant étroitement Bright dans les piles DGX et AI Factory plutôt que de conserver un rôle d'orchestration neutre et multi-fournisseurs », a-t-il expliqué. « Ce choix reflète une tendance stratégique plus large : Nvidia cherche à contrôler l'expérience de l'infrastructure IA de bout en bout. » Selon M. Rawat, Slurm représente un défi fondamentalement différent. « Profondément ancré dans les centres de calcul intensif et le milieu universitaire, et géré de manière efficace par la communauté, Slurm entraîne des coûts de transition élevés », a-t-il fait remarquer. « Nvidia peut exercer une influence, mais il est peu probable que le fournisseur parvienne à reproduire ce même contrôle étroitement intégré sur des marchés dominés par des plateformes établies, neutres et pilotées par la communauté. »

Limites de la sécurité de l’open source

M.Faruqui a reconnu que la licence open source de Slurm, sous licence GNU GPL v2.0, apporte une certaine protection, notamment le droit pour la communauté de créer un fork du projet si la gestion de Nvidia est jugée partiale. Mais il a averti que cette option comportait ses propres risques. « Le statut open source de Slurm offre une soupape de sécurité avec ses limites, mais ce n’est pas un bouclier complet contre la neutralité vis-à-vis des fournisseurs », a-t-il souligné. Ce dernier fait remarquer que cette acquisition a fait entrer chez Nvidia bon nombre des principaux développeurs Slurm mondiaux, ce qui signifie qu’un fork mené par la communauté aurait du mal à maintenir le même rythme de développement. M. Rawat a qualifié la situation de « risque de dépendance stratégique, et non de crise. » Il pense que les entreprises devraient diversifier leurs achats de GPU, comparer les charges de travail au sein d’écosystèmes de plusieurs fournisseurs, et développer une expertise interne pour modifier ou changer d’outils d’orchestration si nécessaire. Quant à M. Faruqui, il recommande aux acheteurs d'entreprise négociant des contrats de support Slurm d'exiger des garanties de niveau de service s'appliquant de manière égale au matériel non-Nvidia, couvrant les délais de réponse, les corrections de bogues et la parité des fonctionnalités sur des clusters hétérogènes. Concernant l'architecture, il a ajouté que les entreprises devraient envisager de conteneuriser les charges de travail d'IA afin d'isoler les applications du planificateur sous-jacent, rendant ainsi la migration vers d'autres planificateurs tels que Flux ou Kubernetes plus facile si nécessaire.

Commentaire