Le big bang de l'IA physique est arrivé. C'est en tout cas ce qu'affirmé Rev Lebaredian, vice-président de l'activité Omniverse et des technologies de simulation chez Nvidia, lors de la dernière GTC 2026 la semaine dernière à San José. Avec plus de de 20 Md$ investis dans ce domaine, le fournisseur de Santa Clara aiguise sa stratégie et a multiplié les annonces, en particulier dans la robotique qui est un des domaines porteurs de ce marché. Le fournisseur a ainsi indiqué que son modèle de raisonnement pour robots industriels dans les usines Groot N1.7 est désormais en accès anticipé et qu'une version N2 arrivera d'ici la fin d'année. Pour étendre l'apprentissage et la simulation robotique, le framework open source d'apprentissage Isaac Lab voit ses capacités étendues à plus de domaines, tandis que le moteur d'IA physique Newton est disponible en v1 pour tous les utilisateurs (téléchargé à ce jour plus de 300 000 fois). Lors de sa conférence, le groupe a aussi annoncé que les grandes sociétés de systèmes automatisés et robots industriels ABB, Fanuc et Kuka, faisaient aussi appel à ses solutions. De plus, 1X, Agility et Figure, les principales entreprises de robots humanoïdes, utilisent aussi des plateformes de simulation du groupe et de calcul en edge pour entraîner et déployer leurs produits, tandis que Skilled AI et Field AI développent des « cerveaux robotiques universels » en s'appuyant aussi sur les technologies de simulation IA de Nvidia.

Des robots dans les usines jusqu'aux salles de chirurgie

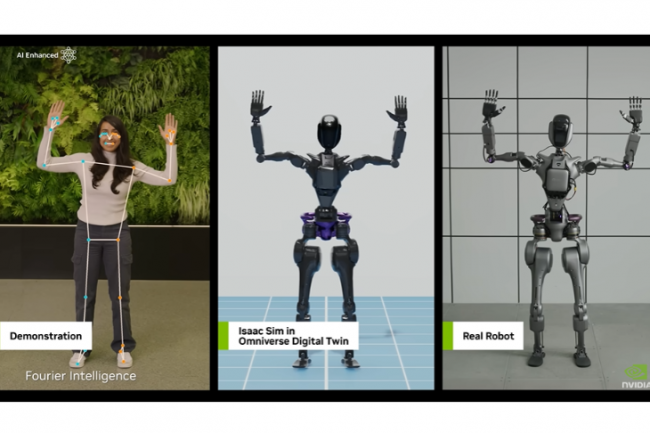

« Ce qui a changé au cours de l'année ou deux passées avec l'introduction du raisonnement dans nos IA, c'est qu'elles ont la capacité de gérer des situations qu'elles n'avaient jamais vues auparavant », a fait savoir Rev Lebaredian, vice-président Omniverse et technologies de simulation lors d'un point presse à la GTC 2026. « Avant, pour construire une IA, en particulier physique, il fallait disposer de données liées à tous les cas possibles de ce qui pourrait se produire dans le monde réel [...] Mais avec le raisonnement, nous pouvons maintenant décomposer la situation même si elle ne fait pas partie de son ensemble de données lors de son entraînement initial ». Le fournisseur voit les robots eux-mêmes comme des agents de raisonnement profonds, y compris les différents robots humanoïdes. Avec un défi principal à relever : concevoir la technologie capable de simuler ces mondes et les réaliser avec suffisamment de précision pour pouvoir entraîner correctement ces robots pour les faire évaluer à l'intérieur de ces mondes virtuels en simulation. Pour y parvenir, la société mise sur des « agents profonds et durables » et des experts en conception 3D, des simulations, et capable d'aider les humains à mettre en place et exécuter ces simulations.

De même, le groupe pousse des ensembles de données, des modèles et des frameworks ouverts pour aider l'industrie de la santé à « former » des robots chirurgicaux afin de faire face à la pénurie attendue de main-d'œuvre dans ce secteur estimée à 10 millions de personnes d'ici 2030 selon Nvidia. Mais aussi CosmoSage, une famille de modèles de monde pour générer des données sur l'environnement chirurgical, et GrootH, son tout modèle VLA (vision, langage, action) pour la robotique chirurgicale et réaliser des tâches chirurgicales complexes. Il faut dire que la robotique transforme discrètement autant les usines que les salles d'opération. Et cette année a été marquée par l'émergence des fameux humanoïdes promis à un bel avenir. « Les déploiements devraient être multipliés par près de dix en 2026 », assure Rev Lebaredian. « Si nous pouvons créer un robot chirurgical capable de fonctionner dans un environnement très contraint où nous avons besoin d'une sécurité extrême mais d'une précision extrême, et de le faire de manière fiable, bien sûr, cela nous aidera aussi à l'intérieur d'une usine ».

Un focus sur l'edge sans oublier le cloud

Toutes les applications IA physique nécessitent des besoins accrus de connectivité aux ressources de calcul et pour cela, Nvidia s'appuie sur l'edge. « Plus elle est proche de l'endroit où vous en avez besoin, mieux c'est. Donc, si vous gérez de grandes quantités de charges IA avec un grand nombre de flux vidéo, le faire plus près de l'endroit où cela se passe réellement est bénéfique », explique Rev Lebaredian. « Dans ce cas, il n'y a plus besoin de transférer autant de données sur Internet, et vous obtenez plus de fiabilité en termes de latence et de réponses. C'est particulièrement crucial pour des tâches comme les charges d'inspection, comme l'état des routes, des lignes électriques, des infrastructures.... A la manière de ce que l'on fait depuis des décennies en termes de réseaux de diffusion de contenu pour le trafic web, on veut faire la même chose pour les calculs IA parce que la quantité de données à traiter est énorme ».

Pour soutenir ses développements en IA physique, le groupe explique par ailleurs qu'il aura toujours besoin de recourir - et plus encore dans les mois et années qui viennent - aux capacités de calcul fournies par les hyperscalers. « Les systèmes les plus complexes que nous construirons auront probablement des calculs à de nombreux endroits différents », fait savoir Rev Lebaredian. « Vous avez du calcul juste sur l'edge, qui tourne réellement dans le robot ou dans le système qui capture toutes les informations sur le monde à cet endroit, du calcul déporté sur l'accès mobile (RAN) avec une latence un peu plus importante. Et ensuite, vous pouvez avoir encore avoir besoin de plus de performance avec le cloud des hyperscalers », explique le responsable. Avant de conclure en estimant « vous pouvez donc étalonner les niveaux de calcul nécessaires ainsi que les temps de réponse en fonction de l'application. »

Commentaire