Microsoft intègre davantage l'IA agentique dans les PC grâce à Fara-7B, un modèle capable d'automatiser entièrement des tâches complexes sur un système en local. Pour l'instant au stade expérimental, il donne un aperçu de la manière dont les agents IA pourraient exécuter des flux de travail sensibles sans envoyer de données vers le cloud, tout en égalant ou surpassant des modèles plus importants tels que GPT-4o dans des tâches réelles de navigation dans l'interface utilisateur. Les modèles d'agents informatiques (CUA) tels que Fara-7B exploitent les interfaces informatiques traditionnelles, telles que la souris et le clavier, pour accomplir des tâches à la place des utilisateurs. « Avec seulement 7 milliards de paramètres, Fara-7B atteint des performances de pointe dans sa catégorie et rivalise avec des systèmes agentiques plus volumineux et plus gourmands en ressources qui dépendent de l'utilisation simultanée de plusieurs modèles de grande taille », explique Microsoft.

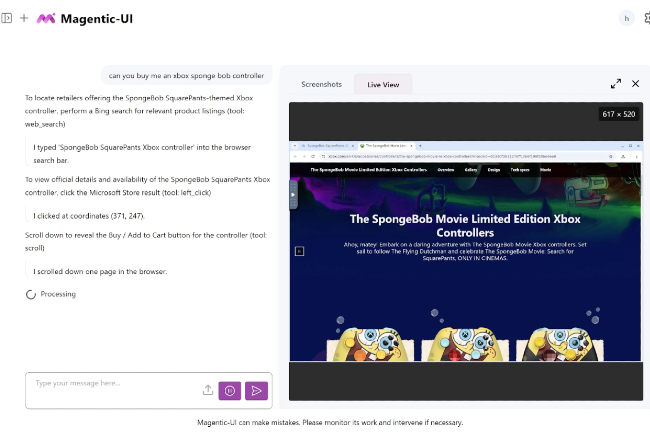

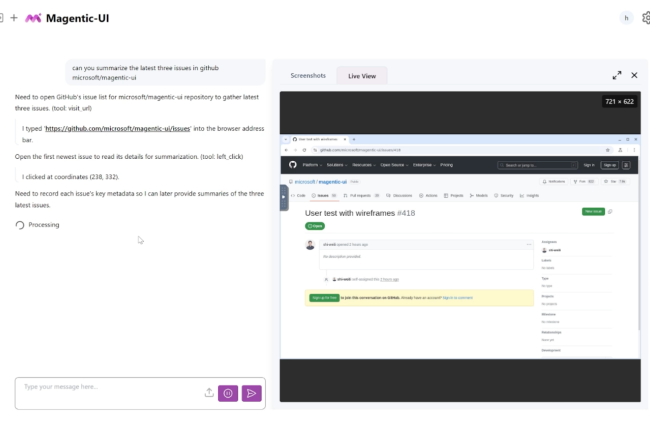

Ce modèle traite les captures d'écran et interprète les éléments à l'écran au niveau des pixels, ce qui lui permet de naviguer dans les interfaces même lorsque le code sous-jacent est complexe ou indisponible. Lors de tests internes, Fara-7B a affiché un taux de réussite de 73,5 % au test WebVoyager, surpassant GPT-4o et son approche Set-of-Marks (SoM). La firme de Redmond a déclaré que son modèle avait également tendance à accomplir les tâches en beaucoup moins d'étapes que de précédents systèmes 7B. Disponible sur Microsoft Foundry et Hugging Face sous licence MIT, il est par ailleurs intégré à Magentic-UI, prototype de Microsoft Research AI Frontiers.

Fara‑7B peut rechercher et analyser des informations en ligne, résumer des contenus, et même effectuer des achats automatiquement. (Crédit: Microsoft)

La bascule vers des modèles locaux

Les analystes soulignent que l'évolution vers des modèles compacts et locaux tels que Fara-7B reflète un changement plus général dans l'architecture IA des entreprises. Les systèmes basés sur le cloud continuent de dominer pour le raisonnement à grande échelle et la recherche à l'échelle. Cependant, de nombreux workloads quotidiens dans les entreprises impliquent la copie de données entre des applications internes sur un ordinateur portable, où les données ne peuvent pas quitter l'appareil. « Les modèles à l'edge résolvent trois problèmes majeurs liés à l'IA dans le cloud : le coût de calcul, la sortie des données d'un système et la latence », a déclaré Pareekh Jain, CEO de Pareekh Consulting. « La plupart des tâches d'entreprise s'effectuent sur des applications internes d'un ordinateur portable, et un agent local est beaucoup plus adapté à cela. » Charlie Dai, vice-président et analyste principal chez Forrester, a déclaré que Fara-7B montre à quel point les agents légers résidant sur des terminaux locaux vont gagner en importance à mesure que les sociétés accélèrent leur adoption de l'IA agentique. « Pour les entreprises, cela annonce une décentralisation progressive des charges de travail de l'IA, réduisant la dépendance à l'égard des infrastructures hyperscale tout en exigeant de nouvelles stratégies pour la gouvernance à l'edge et la gestion du cycle de vie des modèles », a ajouté M. Dai.

Cette tendance reflète également une évolution plus générale vers des architectures d'IA hybrides, dans lesquelles des agents locaux gèrent les flux de travail sensibles en matière de confidentialité et les systèmes cloud continuent d'assurer l'évolutivité, selon Tulika Sheel, vice-présidente senior chez Kadence International. En conservant les données au niveau local et en réduisant la dépendance à l'égard du calcul hyperscale, les petits agents intégrés sur des appareils locaux sont un moyen pratique d'automatiser les tâches sensibles ou répétitives sur les postes de travail sans exposer les informations vers des plateformes externes.

Des défis de performance et de gouvernance à relever

Les agents capables d'interpréter des éléments s'affichant à l'écran au niveau des pixels promettent une compatibilité plus large, car ils peuvent fonctionner dans de nombreuses applications, sans intégrations personnalisées, mais comportent également des risques opérationnels. M. Jain a comparé cette approche à une version améliorée par l'IA de l'automatisation des processus robotiques (RPA), dans laquelle l'agent imite les entrées de la souris et du clavier pour déplacer les données entre les systèmes. « Un agent fonctionnant uniquement au niveau des pixels peut fonctionner dans de nombreuses applications sans alignement ni intégration, ce qui est un avantage considérable », a déclaré M. Jain. « Mais si l'interface utilisateur change, l'agent peut rencontrer des difficultés. Il est puissant, mais aussi fragile. » M. Dai a également déclaré que si les modèles basés sur les pixels apportent une flexibilité dans diverses interfaces utilisateur sans intégration d'API, leur fiabilité dépend de la stabilité de l'interface et de la capacité à mapper la vision en action de façon robuste. « Dans les environnements d'entreprise dynamiques où les interfaces utilisateur changent fréquemment, ces agents risquent d'être fragiles s'ils ne sont pas associés à une gestion des données augmentée, à un réentraînement adaptatif et à des mécanismes de secours. Par conséquent, à ce stade, ils sont plus adaptés aux flux de travail contrôlés qu'à l'automatisation critique », a déclaré M. Dai.

La performance n'est qu'une partie de l'équation. Les entreprises devront également mettre en place des contrôles plus stricts avant d'autoriser ces agents à fonctionner sans surveillance sur leurs systèmes internes. « Ces agents sont pratiques, mais une action malveillante pourrait causer des dommages », a ajouté M. Jain. « Vous devez mettre en place des cadres de gouvernance solides avant de les déployer à grande échelle. » M. Sheel a prévenu que les entreprises devraient définir des points de contrôle humain clairs, par exemple lorsque des « points critiques » apparaissent, conserver des pistes d'audit pour chaque action effectuée par l'agent, appliquer des contrôles d'accès basés sur les rôles et surveiller en permanence les performances et les erreurs. « Elles devraient également inclure une stratégie de correction pour les cas où l'agent commet des erreurs ou se comporte de manière indésirable, et veiller à ce que les politiques de gouvernance des données, de confidentialité et de conformité soient intégrées dans les flux de travail de l'agent », a ajouté M. Sheel.

Commentaire