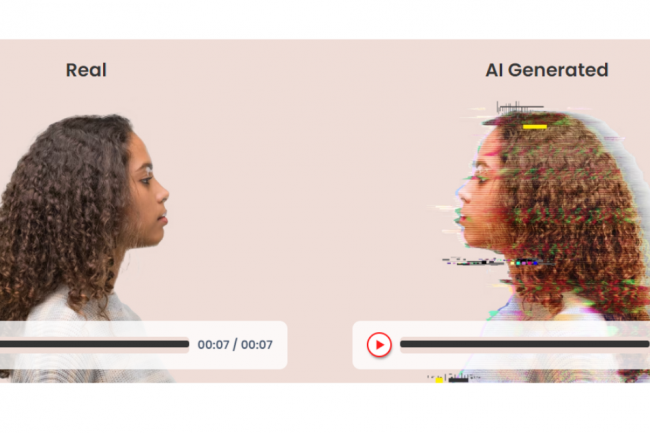

Aussi bien opportunité que menace. Alors que les cas d'usage embarquant l'IA sous toutes ses formes se multiplient et que leurs promoteurs ne manquent jamais de mettre en avant ses bénéfices, cette technologie peut aussi être utilisée à mauvais escient. C'est précisément le cas avec les deep fakes consistant à générer aussi bien des vidéos que des messages audio imitant un modèle humain à tel point qu'il devient très difficile - voire impossible - de déceler le vrai du faux. Pour tenter de protéger les utilisateurs d'usurpations vocales des pirates, McAfee apporte sa contribution avec sa technologie de détection des deepfake audio aka Mockingbird.

Encore à l'état de projet - et clin d'oeil au programme de la CIA destiné à influencer les médias et l'opinion publique dans les années 60 - Mockingbird « a été développé pour aider à défendre les consommateurs contre la menace croissante des cybercriminels qui utilisent des sons générés par l'IA, pour réaliser des escroqueries qui volent de l'argent et des informations personnelles, permettent la cyber-intimidation et manipulent l'image publique de personnalités importantes », explique le fournisseur de sécurité. « Des outils d'IA générative de plus en plus sophistiqués et accessibles ont permis aux cybercriminels de créer plus facilement des escroqueries très convaincantes, comme l'utilisation du clonage de voix pour se faire passer pour un membre de la famille en détresse et lui demander de l'argent. D'autres, souvent appelées cheapfakes, peuvent consister à manipuler des vidéos authentiques, comme des journaux télévisés ou des interviews de célébrités, en y insérant un faux son pour modifier les mots qui sortent de la bouche de quelqu'un ; cela donne l'impression qu'une personne de confiance ou connue a dit quelque chose de différent de ce qui a été dit à l'origine ».

Des craintes de détournement variées

Annoncée à l'occasion du CES 2024 (9-12 janvier 2024), la technologie de détection des deepfake audio de McAfee n'a pas été encore détaillée mais disposerait d'une précision supérieure à 90 %. Selon une dernière étude de l'éditeur de décembre 2023 sur les deepfakes, 84 % des Américains sont inquiets sur la façon dont ils vont être utilisés en 2024 et 57 % en particulier pour la prolifération de scams. L'utilisation de deepfakes à des fins de cyber-intimidation préoccupe 44 % des Américains et plus de la moitié (52 %) craignent que leur augmentation influence les élections, réduise la confiance du public dans les médias (48 %) et servent à usurper l'identité de personnalités publiques (49 %). En mai dernier, McAfee a présenté une étude globale sur la percée de l'IA utilisée dans des cyberattaques et au passage montré un exemple révélateur de la difficulté pour un humain à ne pas se faire tromper par un deepfake audio.

Commentaire