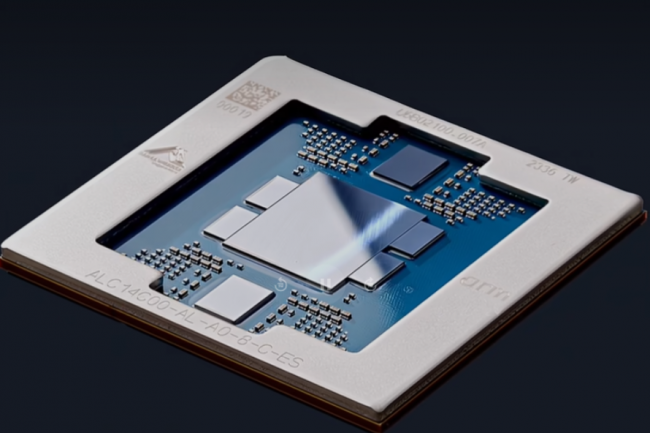

Annoncé par Meta en fin de semaine dernière, le partenariat avec Amazon Web Services prévoit d'intégrer « des dizaines de millions » de cœurs Graviton 5 [chaque puce contient 192 cœurs Arm Neoverse V3 gravés en 3 nm par TSMC, NDLR] à son portefeuille de ressources de calcul. Il est par ailleurs prévu d'étendre cette capacité à mesure que les besoins IA du géant des réseaux sociaux se développent. Le créateur de Llama deviendra ainsi l'un des plus grands clients Graviton au monde. L’initiative s'inscrit dans le prolongement des partenariats étendus de Meta avec d'autres fournisseurs de puces et de ressources de calcul du secteur dont AMD, CoreWeave et Nvidia, sachant que Meta développe aussi - avec Arm - sa propre puce interne d’accélération pour l’entraînement et l’inférence. « Avec ces multiples accords sur les puces et ces annonces concernant le développement en interne, il est très difficile de suivre tout ce que fait Meta », a reconnu Matt Kimball, vice-président et analyste principal chez Moor Insights & Strategy, ajoutant que « cette période passionnante montre à quel point le silicium est particulièrement précieux aujourd’hui ».

Maitriser des charges de travail IA intensives

Les processeurs graphiques (GPU) sont indispensables à l'entraînement des grands modèles de langage (LLM), mais l'IA agentique nécessite des capacités de traitement les plus récentes. Des processeurs comme Graviton 5 relèvent ce défi par leur capacité à traiter des charges de travail intensives comme le raisonnement en temps réel, les tâches en plusieurs étapes, l'entraînement de modèles frontier, la génération de code et la recherche approfondie. AWS affirme que Graviton5 est capable de gérer « des milliards d'interactions » et de coordonner des tâches agentiques complexes en plusieurs étapes. Le GPU s'appuie sur le système AWS Nitro pour garantir des performances, une disponibilité et une sécurité élevées. « Il s'agit vraiment de contrôler le système IA, et pas seulement l'échelle », a expliqué Matt Kimball. À mesure que l'IA évolue vers des charges de travail persistantes et agentiques, le rôle du CPU devient « tout à fait significatif » : il sert de plan de contrôle, gérant l'orchestration, la mémoire, la planification et d'autres tâches intensives à travers les accélérateurs. « C'est particulièrement vrai dans les environnements agentiques, où les charges de travail seront moins linéaires et liées davantage à des états », a-t-il souligné. Il est donc tout à fait logique de garantir l'approvisionnement de ces ressources.

Diversifier l'approche matérielle traditionnelle

Si cet accord s’appuie sur le partenariat de longue date entre Meta et AWS, il reflète également ce que l’entreprise appelle son « approche diversifiée » de l’infrastructure. « Aucune architecture à puce unique ne peut prendre en charge efficacement toutes les charges de travail », a fait remarquer le fournisseur. Pour illustrer ce point, Meta a récemment annoncé quatre dernières générations de sa puce d'accélération pour l'entraînement et l'inférence MTIA et a conclu en février dernier un accord colossal avec AMD afin de s'assurer l'accès à 6 GW de processeurs et d'accélérateurs IA. De plus, l'entreprise a conclu un partenariat pluriannuel avec Nvidia pour accéder à des millions de GPU Blackwell et Rubin et intégrer ses accélérateurs réseau Ethernet Spectrum-X à sa plateforme. C’est aussi l'un des premiers grands clients d'Arm en matière de processeurs. Dans ce contexte, Nabeel Sherif, consultant principal chez Info-Tech Research Group, s’est demandé ce que Meta allait faire de toute cette capacité. Selon lui, elle servira essentiellement à soutenir l’expérimentation et l’innovation internes de Meta, ajoutant que sur cette base, l’entreprise pourra également fournir la capacité nécessaire pour proposer ses propres services d’IA agentique sur le marché, par exemple son modèle Llama sous forme d’API. « Il est difficile de dire pour l’instant à quoi ressembleront ces services, quelles plateformes et quels outils ils utiliseront, ainsi que les garde-fous qu’ils mettront en place pour les utilisateurs, mais il sera intéressant de voir comment cela évoluera », a déclaré M. Sherif.

« Ce surcroît de capacité pourra satisfaire une grande diversité de cas d’usage et d'expérimentation sur différentes architectures et plateformes », a-t-il estimé. Meta disposera ainsi de nombreuses options et d'un accès à l'approvisionnement dans un contexte actuellement marqué non seulement par une grande variété d’approches en matière de processeurs, mais aussi par d'importantes contraintes au niveau de la chaîne d'approvisionnement. Selon lui, l'accord avec AWS doit être considéré comme un complément aux partenariats et investissements de Meta dans d'autres plateformes telles qu'Arm, Nvidia et AMD. Matt Kimball a convenu que cette initiative est « très certainement complémentaire », et non un remplacement ou une substitution. « Meta ne se détourne pas des GPU ou des accélérateurs, mais construit autour d’eux, l’objectif étant d’assembler un système hétérogène, et non de choisir un seul gagnant », a-t-il poursuivi. « En fait, je pense que pour la plupart, l’hétérogénéité est essentielle au succès à long terme », a-t-il avancé. Nvidia domine toujours l’entraînement et une grande partie de l’inférence, tandis qu’AMD devient « de plus en plus pertinent à grande échelle », a encore noté Matt Kimball. Quant à Arm, que ce soit par le biais de CPU, de puces sur mesure ou d’autres initiatives, le concepteur apporte à Meta un contrôle architectural, et Graviton 5 s’intègre dans cet ensemble en tant que « couche de calcul polyvalente optimisée en termes de coût et d’efficacité. »

Efficacité et TCO vs performance

La question la plus intéressante concerne la stratégie. Matt Kimball ne pense pas que Meta soit en train de devenir un fournisseur de puissance de calcul, ni que l’entreprise cherche à concurrencer directement les hyperscalers en tant que fournisseur cloud polyvalent. Selon lui, il s’agit davantage d’une intégration verticale de leur propre pile d’IA. « Avec cette évolution, Meta pourra supporter les charges de travail internes plus efficacement, tout en fournissant l’infrastructure nécessaire pour mettre une part plus importante de ces capacités à la disposition de l’extérieur, que ce soit par le biais d’API, de partenariats ou d’autres moyens », a-t-il expliqué. Matt Kimball pense aussi qu’il y a une dynamique de coûts à prendre en compte. À mesure que l'inférence devient persistante, en particulier avec les systèmes agentiques, les enjeux économiques s'éloignent du pic d'opérations en virgule flottante par seconde, Flops - une mesure de la performance de calcul - pour se tourner vers l'efficacité soutenue et le coût total de possession. Les processeurs comme le Graviton 5 sont bien placés pour les parties de cette charge de travail qui ne nécessitent pas d’accélérateurs, mais doivent tout de même fonctionner en continu.

« À l’échelle de Meta, même de petits gains d’efficacité par charge de travail s’accumulent rapidement », a souligné Matt Kimball. « Pour les développeurs et les services IT d’entreprise, le message est assez clair : la pile IA devient de plus en plus hétérogène, et non l’inverse. Les entreprises vont assister à un couplage plus étroit entre les processeurs, les cartes graphiques et les accélérateurs spécialisés, les charges de travail étant de plus en plus réparties entre eux en fonction de leur comportement (préremplissage ou décodage, sans état ou avec état, en rafale ou persistant) », a-t-il encore déclaré. « Cela implique que les décisions d’infrastructure doivent davantage tenir compte des charges de travail », a poursuivi Matt Kimball. « Il s’agit moins de se demander sur quel cloud elles sont exécutées que de savoir où telle partie spécifique de l’application peut s’exécuter le plus efficacement. »

Commentaire