« Depuis un an, nous constatons un vrai passage à l’échelle de projets IA. Chez Dell Technologies, nous avons d’ailleurs créé l’AI Factory en ce sens, de proposer un framework, capable d’industrialiser les projets IA tout en s’adaptant au contexte du client », mentionne Eric Bezille, directeur technique et responsable des avant-ventes chez Dell Technologies. Plus précisément, la Dell AI Factory renferme un cadre composé d’un ensemble de solutions logicielles (dont l’AI Data platform pour le pilier data), de services d’accompagnement et d’infrastructures performantes car il faut aussi de la puissance de calcul et des capacités de stockage pour mettre en production localement un projet IA de type RAG (ou moteur de recherche sémantique). En effet, l’encombrement des données vectorielles nécessite des besoins importants en stockage de données et de la synchronisation en temps réel. Dell apporte ainsi des capacités et des performances par exemple avec son système de stockage objet full flash ObjectScale XF960 qui se distingue déjà par sa densité, en effet il prend en charge des disques QLC de 61 To, et avec des configurations allant de 6 à 24 SSD par nœud, les clusters peuvent évoluer de 230 To à 23,6 Po par rack. Une option QLC de 122 To, avec jusqu'à 47 Po par rack, sera bientôt disponible, offrant une capacité brute jusqu'à 8 fois supérieure à celle de son prédécesseur. En associant cette appliance aux baies PowerScale, les entreprises peuvent bénéficier de solides performances pour couvrir des charges de travail d'IA et d'analyse, de l'ingestion initiale des données à l'apprentissage des modèles et au déploiement des inférences. De plus, Dell s’est récemment associé au distributeur TD Synnex pour créer un lab IA dont l'objectif est d'aider les entreprises à concevoir, à tester et à déployer des solutions d'IA à grande échelle. Pour cela, les clients pourront s'appuyer sur l'architecture Agentic RAG et l'AI Factory du texan (serveurs PowerEdge R760 dotés de deux GPU H100, d'un DPU BlueField-3, de switch Spectrum-X, d'un stockage PowerScale F210, ainsi que de la suite logicielle Nvidia AI Enterprise). Le site, qui sera pleinement opérationnel d'ici à la fin de l'année, devrait être hébergé en région parisienne dans les locaux du distributeur.

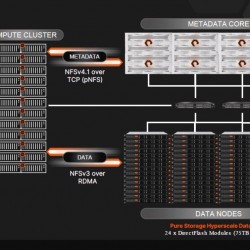

De son côté, NetApp a récemment dévoilé sa gamme de baies de stockage désagrégé AFX hautes performances spécialement conçue pour la préparation et la gestion des données en amont d’un projet IA comme l’explique Sandeep Singh, vice-président senior et directeur général du stockage d'entreprise chez NetApp dans son blog. Sa particularité est qu’elle est déjà certifiée avec les systèmes DGX SuperPod de Nvidia. Dans sa configuration maximale, ce système peut en effet gérer jusqu'à 128 nœuds et sa bande passante grimpe à plusieurs téraoctets par seconde pour une performance exascale affirme le fournisseur. Les nœuds de contrôle des données DX50 (en option) apportent un contrôle renforcé des métadonnées (pour pNFS notamment) et tirent parti du calcul accéléré Nvidia. Huawei a fait de même avec ses baies OceanStor AI. L’un des piliers de cette solution est l’optimisation des performances de stockage pour les workloads IA, notamment pour le training et l’inférence des modèles. Cette gamme conçue pour les environnements AI, se distingue par ses performances élevées. Enfin, chez Pure Storage, l’IA exige un accès instantané, fluide et illimité aux données et pour répondre à ces exigences, le fournisseur propose les FlashBlade Exa qui viennent s’ajouter aux nouvelles gammes Flashblade S R2 et Flasharray XL R5 et ST annoncées lors de son événement Accelerate en juin dernier à Las Vegas. Les baies Flashblade Exa répondent au traitement massivement parallèle des métadonnées car les systèmes actuels, selon le fournisseur, ne sont pas vraiment adaptés, elles peuvent être montées dans un cluster comprenant jusqu’à 10 châssis (10 lames par chassis) et dont la performance en lecture monterait à plus de 10 téraoctets par seconde. Si hier, certains DSI se posaient des questions sur l’envolée des performances sur les baies de stockage full-flash supportant le protocole NVMe over Fabric pour les bases de données, l’analytique et les environnements virtualisés, l’arrivée de l’IA justifie aujourd’hui les investissements en R&D de ces dernières années chez Dell, HPE, Pure Storage, NetApp et bien sûr Huawei

Commentaire