Flux RSS

Infrastructure serveur

2924 documents trouvés, affichage des résultats 1181 à 1190.

| < Les 10 documents précédents | Les 10 documents suivants > |

(30/03/2010 14:25:23)

Belfast, terre d'accueil pour les entreprises IT

De la situation géopolitique aux efforts réalisés pour attirer les investisseurs à Belfast, l'Irlande du Nord dispose de beaucoup d'attraits pour les entreprises. Les activités technologiques sont propices à ce climat socio-économique et se développent dans plusieurs domaines. Enfin, les liens entre l'université et l'entreprise aboutissent à la création de société mêlant recherches et industrie.

Pour consulter notre dossier, nous vous invitons à cliquer sur ce lien : Belfast, terre d'accueil pour les entreprises IT

Photo : Projet du quartier d'affaires Titanic (...)

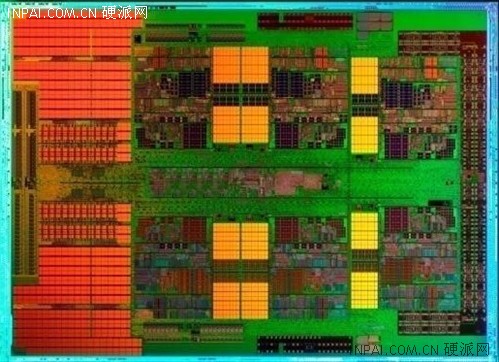

Opteron 6100 : Un gros 12 coeurs AMD pour contrer les 6 coeurs d'Intel (MAJ)

Face à un concurrent toujours plus redoutable qui vient de dévoiler ses plates-formes bi et quadri sockets pour serveur (Intel Xeon Westmere 32 nm et Nehalem-EX 45 nm), AMD double le nombre de coeurs disponibles dans sa ligne de processeurs pour serveurs bi et quadri sockets avec la génération Magny-Cours. Le gain de performance attendu avec ces Opteron est environ le double des précédentes puces six coeurs selon AMD. Il faut bien évidemment comparer ces benchmarks avec ceux des Xeon Westmere 5600 et des Nehalem-EX 7500/6500, notamment sur les points des performances brutes et de la consommation électrique. Seul bémol sur ce dernier point, AMD communique ses chiffres en se basant sur la consommation moyenne (ACP) alors qu'Intel livre des données de type TDP (consommation maximale). Difficile de vraiment comparer l'enveloppe thermique des deux plates-formes dans ces conditions.

Dans son premier communiqué de presse sur la question, AMD ne compare toutefois les benchmarks de l'Opteron 6174 deux sockets que face au Xeon 2 voies X5680 (voir infographie ci-dessous). Le premier constat est qu'AMD a besoin de 12 coeurs pour faire le travail d'un six coeurs chez Intel mais avec une enveloppe thermique difficile à comparer (105 Watts en ACP contre 130 chez Intel en TDP). Un point pourtant particulièrement important quand on densifie ses salles informatiques pour réduire le nombre de serveurs. Les X6500 d'Intel (bi socket Nehalem-EX ) n'ayant pas encore été officiellement dévoilés, il est encore nécessaire d'attendre quelques heures pour confronter ces nouveaux bi sockets face à face...

Le fondeur entend bien tirer à profit les gains offerts par cette plate-forme pour convaincre les entreprises de remplacer leurs serveurs bi sockets par sa solution. Un des principaux avantages mis en avant par AMD est la réduction des coûts de licences logicielles. En 2004, avec l'arrivée des processeurs double coeur, Microsoft avait annoncé qu'il continuerait à licencier ses logiciels en prenant comme base les processeurs, et non pas le nombre de coeurs par puce. De nombreux fournisseurs ont une approche similaire mais cette pratique commerciale n'est pas universelle.

[[page]]

Pour Matt Lavallée, directeur technique de la société MLS Property Information Network (Shrewsbury, Massachusetts) qui fournit des données immobilières à des sites marchands, le passage 4 à 12 coeurs sur ses serveurs Opteron lui permettra de réduire le nombre de ses serveurs et de diminuer les coûts de ses licences logicielles. Matt Lavallée qui a déjà effectué des tests avec des préversions de Magny-Cours estime que l'utilisation de puces douze coeurs de base, qui coûtent un peu plus chers que les huit, est un bon moyen de réduire les coûts de ses serveurs SQL.

SIA exploite 60 serveurs, et son directeur technique pourrait théoriquement réduire de moitié son nombre de machines avec une évolution vers Magny-Cours. Prudemment, il envisage de diminuer d'un tiers seulement ses serveurs avec une mise à jour au niveau des puces. Matt Lavallée explique avoir commencé à utiliser des puces Opteron il y a environ deux ans et demi, et estime que le principale avantage de ces puces résident dans leur débit très important (jusqu'à 5,2 Gb/s, voir encadré).

Gordon Haff, analyste chez Illuminata, précise que c'est la performance, et non le nombre de coeurs, qui compte sur ces puces. Il s'attend à ce qu'Intel et AMD offrent au final des performances similaires mais en utilisant des approches différentes. AMD dispose de 10 options de tarification en fonction du nombre de coeurs, des cadences d'horloge et de la consommation électrique : compter environ 455 $ pour une puce huit coeurs à 1,8 GHz (65 Watts) et 1 386 $ pour un 12 coeurs à 2, 3 GHz (105 Watts).

(...)(29/03/2010 12:41:09)

Dépenses SOA : +24% entre 2008 et 2013, selon IDC

« Certains sur le marché prétendent que c'en est fini de la SOA. Rien n'est plus faux », a rectifié Ruediger Spies, vice-président d'IDC Central Europe pour les applications d'entreprise, lors de la conférence « SOA and Beyond » (SOA et au-delà) organisée la semaine dernière à Londres par le cabinet d'études. Pour le consultant, l'intérêt qui se manifeste en ce moment autour du cloud computing constitue notamment un catalyseur pour investir dans les architectures orientées services. Selon lui, entre 2008 et 2013, les dépenses SOA auront augmenté de 24% dans la zone EMEA (Europe, Moyen-Orient, Afrique), de 23,2% en Asie/Pacifique et de 24,7% sur le continent américain. C'est cette troisième région qui tirera la croissance, a précisé le consultant d'IDC, en expliquant que l'augmentation serait moindre en Europe où les entreprises disposent d'une meilleure architecture informatique qu'aux Etats-Unis, mieux intégrée.

Les projets SOA exigent de bien comprendre les besoins métiers

Ruediger Spies a rappelé que le succès des architectures orientées services impliquait pour l'entreprise de construire une vision à long terme. « Ce sont des projets dont la durée de vie dépasse celle des ERP, qui courent sur douze ou treize ans », rappelle l'analyste. Il recommande aussi que les architectes SOA définissent une valeur métier qui permette aux opérationnels de comprendre en quoi elles contribuent à améliorer les performances de l'entreprise. « Il s'agit avant tout d'intégration [entre applications]. Le responsable du projet doit comprendre les besoins des métiers. Il ne faut pas choisir un jeune diplômé qui vient juste de sortir de l'école, mais s'appuyer sur quelqu'un qui sera reconnu à la fois par les utilisateurs métiers et par les équipes informatiques », insiste Ruediger Spies.

L'analyste explique aussi qu'un projet SOA correctement défini fournira les bases pour les stratégies de BPM (gestion des processus métiers) qui, selon lui, sont très proches du cloud computing. Ce dernier, estime-t-il, ne constitue qu'une option supplémentaire lorsqu'une entreprise doit choisir une solution informatique ou remplacer ses systèmes en place. Et Ruediger Spies d'insister : si vous avez mis en place convenablement votre architecture orientée services, vous aurez votre feuille de route pour élaborer vos architectures de processus et d'information et la façon dont elles doivent se combiner. »

Oracle explique les vertus de la fusion à ses clients

A l'époque du rapprochement entre HP et Compaq, nombreux étaient les clients des deux sociétés, notamment le groupe Decus, qui s'interrogeaient sur l'abandon ou la continuité de certains programmes ou produits, Tandem et Himalaya. Pour éviter ce piège, Oracle a, quelques semaines après l'approbation de la fusion par la Commission européenne, organisé un événement partenaires et clients, dans les locaux de l'activité France. Le directeur général, Pascal Dumontet, a présenté le travail commun, réalisé depuis avril 2009, date de l'annonce de la fusion avec Sun Microsystems. Si le quitus européen existe, les deux entités françaises sont encore indépendantes juridiquement. La fusion ne devrait être effective qu'au mois de juillet prochain. Ces efforts ont symboliquement transformé, jusqu'à la communication institutionnelle d'Oracle, qui change sa ligne directrice « Software. Hardware. Complete ». Elle rappelle la volonté de fournir des solutions de bout en bout, allant du stockage aux applications. Pascal Dumontet a également insisté sur les investissements dans la R&D qui sont prévus d'ici 2011 à hauteur de 4,3 milliards de dollars dont une grande partie affectée à l'intégration des technologies.

Une combinaison de valeurs

En dehors du discours commercial bien rôdé, les différentes interventions des représentants de Sun et d'Oracle ont démontré l'intégration du meilleur des deux mondes. Sue Oliva, vice-président de Sun Microsystems France souligne que « cette fusion est une suite naturelle de notre partenariat qui existait depuis plusieurs années, elle apporte aujourd'hui des réponses communes tant sur le plan commercial avec un portefeuille complet, mais également un support unique ». Alors quelle en est la traduction ? Sur la partie des équipements, Eric Bézille, ingénieur en chef chez Sun montre que les solutions matérielles vont intégrer des fonctionnalités d'optimisation des applications. Pour ce faire, les supports de stockage Flash, de type SSD devraient de plus en plus intégrer les serveurs (des annonces sont prévues le mois prochain) y compris ceux de volumes comme les x86. Cela doit répondre à la demande de plus en plus croissante de rapidité dans les transactions, mais également dans le traitement des requêtes des bases de données. Sur la partie software, pas d'inquiétude à avoir sur l'avenir de Solaris, le système d'exploitation reste « une clé de voûte » des recherches d'Oracle en gardant la spécificité Open Source et en aidant la communauté Open Solaris dans ses travaux. Solaris 10 et les évolutions d'OpenSolaris doivent arriver prochainement. Sur la partie développement, les récentes déclarations lors de l'EclipseCon démontrent l'implication d'Oracle à poursuivre les travaux sur Java et toutes ses composantes à travers le serveur d'applications Glassfish.

A l'issue des différentes présentations, les partenaires et les clients étaient plutôt rassurés, seules quelques inquiétudes sur les retards dans la fourniture de certains produits persistées, ce qui finalement était plutôt bon signe.

(...)(23/03/2010 18:15:41)TurboHercules attaque IBM pour pratiques déloyales

Big Blue se trouve au coeur d'une nouvelle affaire concernant ses grands systèmes. Après PSI en 2008, se traduisant par le rachat de ce dernier par IBM et T3 Technologies a déposé plainte au début de l'année 2009, c'est au tour d'une jeune société, TurboHercules, d'attaquer IBM pour pratiques déloyales auprès de l'exécutif européen. La société, créée en 2009, développe un émulateur Open Source pour mainframe S/370 et S/390 , qui repose sur la plateforme Hercules (projet communautaire Open Source lancé il y a 10 ans), permettant d'exécuter des applications clients sur des PC ou des serveurs X86, Alpha, Sparc ou PowerPC avec les systèmes d'exploitation (Linux, Windows, Solaris etc.). Or « IBM empêche nos clients d'utiliser Hercules en liant les systèmes d'exploitation des mainframes au hardware de la compagnie.

Ce comportement interdit TurboHercules de proposer ses propres logiciels aux utilisateurs qui souhaitent acquérir une solution Open Source » affirme Roger Bowler, PDG de la société plaignante et fondateur du projet Hercules. Réfutant l'idée d'être « un anti-IBM », le dirigeant a expliqué dans un communiqué « à l'origine, nous avons demandé par écrit à IBM d'octroyer à ses clients, à des conditions raisonnables et justes, la licence de son système d'exploitation mainframe à des fins d'utilisation avec Hercules. IBM a refusé notre demande, mais en plus a déclaré que l'Open Source mainframe d'Hercules violait la propriété intellectuelle d'IBM ».

Illustration Roger Bowler, PDG de TurboHercules et fondateur du projet Hercules

(...)(23/03/2010 17:02:17)Un centre de post-production vidéo 100% Mac

« Hogarth représente une claire évolution dans le domaine de la production vidéo » affirme Mark Rhys Thomas cofondateur de la société. « Depuis que notre solution est opérationnelle, nous sommes devenus plus efficaces » poursuit-il. Une efficience au service des agences de créations: « Nous ne créons rien mais endossons tout le travail de post-production dans sa globalité, de la réception des fichiers bruts à leur livraison en produits finis » explique Mark Rhys Thomas, « nous récupérons des vidéos de 60 secondes pour y appliquer plus de 400 variations. Avoir une infrastructure solide et rapide était primordiale » ajoute Mark Rhys Thomas.

Développer sa propre infrastructure

Après avoir tenté de développer sa propre infrastructure serveur, Hogarth s'est emparée des fonctionnalités offertes par Final Cut Serveur, Esko, Zynet et quelques autres logiciels pour élaborer une architecture parallèle baptisée Fido (Full intégration data operating). Le studio est ainsi parvenu à homogénéiser son parc informatique avec un petit data center Xserve et Xsan, près de 200 ordinateurs iMac, ainsi que toutes les données de ses différents logiciels. «Si une machine devient inutilisable, il suffit d'en choisir une autre pour retrouver ses données personnelles» explique le directeur technique d'Hogarth, Mark Keller. « Chaque ordinateur a la même base, mais les données personnelles des utilisateurs se trouvent conservées dans leur session, sur notre serveur». Concernant les logiciels, Fido agit comme une interface qui gère et rassemble les données communes à tous les logiciels de l'entreprise comme, Esko (logiciel pour impressions) et Zynet (design Internet). «C'est plus dur que ce que vous pensez » explique Mark Keller, « Les applications comme Final Cut Server ont tous leur propre cache enfouit dans les fichiers utilisateurs ». Fido permet donc de gagner en rapidité et en efficacité en envoyant ces informations propres à chaque logiciel, du serveur à la machine, dès le démarrage de chaque session.

[[page]]

« Final Cut Server nous a permis d'être plus efficace, tout en réduisant nos coûts de développement. En à peine deux ans d'existence, nous sommes passés de 60 à plus 200 employés. Nous prévoyons même d'ouvrir des filiales à New York et Shanghai. » Explique Mark Rhys Thomas, qui perçoit le logiciel d'Apple, comme la pierre angulaire du succès de l'entreprise. La plate-forme Fido aide entre autres, à la traduction instantanée des fichiers, et offre la possibilité aux collaborateurs de communiquer entre eux, de se donner des ordres mutuellement, et de voir s'afficher des alertes logicielles, lorsque des fichiers sont prêts. Fido offre également la possibilité de s'éloigner du travail linéaire, par la collaboration en simultanée, sans problèmes de conflits entres ordinateurs. À chaque ouverture de session, tout est transféré depuis le coeur du serveur, et tout y est réenregistré à chaque fin de session.

Un savoir-faire désormais exportable

« Notre interface unique gère les avancées de toutes les productions en temps réel, et nous avons même une version web permettant d'envoyer les données de Final Cut Server vers un poste de travail ». Travailler avec le logiciel d'Apple devient alors plus intuitif, chaque projet est référencé et facile à retrouver. Lorsqu'on leur demande pourquoi ils ont choisi Apple, les responsable d'Hogarth plaisantent en affirmant que c'est par paresse, « C'est aussi une façon différente de travailler, Apple était la solution la plus adaptée car ce n'est jamais le problème qui importe c'est la façon dont vous le résolvez». Mark Keller a également affirmé que la firme à la pomme était la seule société qui pouvait fournir des serveurs, 24 baies de stockage de 150 To ainsi que de multiples applications « à un prix raisonnable ». Aujourd'hui, Hogarth fait même profiter les autres entreprises de son savoir-faire numérique à travers sa filiale Cortex dirigée par Mark Keller.

NTT Communication prend pied dans le cloud

Certains diront un de plus, mais les opérateurs télécoms à vocation internationale saisissent l'opportunité du cloud pour proposer des offres spécifiques sur le sujet. L'opérateur japonais NTT qui dispose d'une entité, baptisée NTT Communications, dont une unité d'affaires est dédiée aux services managés, NTT Europe Online, n'échappe pas à cette règle en proposant une solution baptisée Global Virtualization Services. Stéphane Estevez, responsable produit de NTT Europe Online explique que cette offre « s'adresse à l'activité infrastructure en mode IaaS (Infrastructure as a service) alliant puissance de calcul et machines virtuelles. Notre stratégie pour cette année est d'assister les entreprises dans leur migration vers ces nouveaux modèles, en gérant tous les types de cloud dans une vision globale ». L'avantage de la solution pour les entreprises disposant de plusieurs sites dans le monde est d'avoir un interlocuteur unique aussi bien sur le plan du support, que sur le portail d'administration, qui leur offre de nombreuses fonctionnalités de design d'architecture, d'installation et de gestion des opérations. (...)

(19/03/2010 17:20:03)Plate-forme serveur quatre sockets au prix de deux chez AMD

Pour contrer la montée en puissance de son concurrent Intel qui vient de lancer sa plateforme bi-socket Xeon 5600 Westmere 32 nm (avec 4 ou six coeurs), AMD a décidé de se battre sur le front des prix. Le fondeur proposerait en effet sa plate-forme Opteron Maranello qui peut accueillir quatre sockets Opteron « Magny-Cours » (8 à 12 coeurs) dans la même fourchette de prix que les deux sockets d'Intel. Leslie Sobon, vice-président des produits et du marketing chez AMD a expliqué à nos confrères de CIO que les serveurs quatre sockets avaient été commercialisés à un prix injustifié, mais les systèmes utilisant l'Opteron Magny -Cours allaient changer cela. «La taxe sur les systèmes 4P (4 socket) a arbitrairement maintenu le marché a un niveau très bas , 5% en volume » précise-elle .

Bien entendu, Intel pourrait couper l'herbe sous les pieds d'AMD en baissant ses prix, mais ce genre de pratique est moins susceptible de se produire depuis le dernier jugement de l'UE. Intel avait en effet été accusé d'utiliser des tactiques injustes afin de maintenir sa part de marché dominante.

(...)| < Les 10 documents précédents | Les 10 documents suivants > |