Flux RSS

R et D

956 documents trouvés, affichage des résultats 81 à 90.

| < Les 10 documents précédents | Les 10 documents suivants > |

(13/06/2011 10:21:39)

USI 2011 : Connecter les objets et rendre intelligible la vie des utilisateurs (entretien avec Rafi Haladjian)

LeMondeInformatique : Vous avez cofondé la société Violet qui a donné naissance à différents objets communicants, dont le Nabaztag, et vous interviendrez le 29 juin prochain dans le cadre de l'USI 2011 sur l'intérêt de connecter ensemble les objets. Sous quel angle prévoyez-vous d'aborder ce sujet ?

Rafi Haladjian : Le slogan de Violet, en 2003, c'était « Make all things be connected ». Dans notre vision, tous les objets pouvaient être connectés. Depuis, sept ou huit ans ont passé. L'Internet des objets dont on ne parlait pas du tout à l'époque est devenu un sujet sinon brûlant, en tout cas chaud, dont on parle un peu partout. Mais notre réflexion a également évolué et nous pensons que, précisément, connecter les objets n'est pas la bonne façon de poser le problème. Je me suis rendu compte, lorsque l'on parlait de l'Internet des objets, que l'on imaginait souvent quelque chose d'assez futuriste. Il y a toujours ce mythe du réfrigérateur communicant que chacun imagine avoir un jour et c'est finalement assez gênant. Je pense que ce qui est en jeu et ce qui est en train de se produire, ce n'est pas tant la connexion des objets entre eux, mais le fait que l'on est en train de déborder les frontières de l'ordinateur et du téléphone portable pour rendre intelligible l'espace physique dans lequel nous vivons. Jusqu'à présent, l'interaction que l'on avait avec les ordinateurs, avec les données ou avec les systèmes intelligents, se faisait à travers un guichet qui était un écran.

C'est-à-dire à travers un terminal, quel qu'il soit ?

...à travers un dispositif vers lequel on se tournait pour faire ses transactions. Aussi commode et petit, puisse-t-il être, là n'est pas la question. Mais ce qui se passait réellement dans le monde physique, le monde réel, était inconnu. C'était une espèce de zone d'ombre dont on ne tenait pas compte. L'utilisateur venait devant son écran, déclarait un certain nombre de choses : « voilà ce que j'écris, ce que je pense, ce que je fais ». Alors que désormais, de plus en plus, il y a des dispositifs qui permettent d'occuper le reste de l'espace, comme les GPS, ou les accéléromètres que l'on trouve sur les iPhone. Tout un ensemble de dispositifs qui existent déjà. Donc, cette tendance à rendre intelligible le reste du monde physique est quelque chose qui commence à se produire. Et, l'Internet des objets, c'est avant tout cela. Ce n'est pas le fait de connecter les réfrigérateurs, ce qui est anecdotique et accessoire. Il faut voir le vrai sens de ce qui est en train de se passer.

Quel va être le rôle de ces dispositifs ?

L'objectif, c'est de comprendre ce qui se passe dans la vie des gens, de rendre intelligible ce qu'ils sont en train de faire sans qu'ils aient besoin de le dire. Par exemple, dans une conférence, si l'on veut savoir ce que l'auditoire a pensé de l'exposé, on demande aux participants de remplir un formulaire ou d'aller sur une application pour donner leur appréciation. On pourrait procéder autrement. Ce que j'ai vu à l'Université de Bilbao, par exemple, ce sont des prototypes de fauteuils dans lesquels on a placé des capteurs de pression, tout bêtes, qui sondent la façon dont les gens sont assis sur leur fauteuil. Sont-ils avachis, signe que, peut-être, ils s'ennuient ? Semblent-il au contraire attentifs à qu'ils sont en train d'écouter ? Vous pouvez de cette façon avoir une compréhension immédiate de ce que les gens sont en train de penser de la présentation en cours, sans que les personnes aient forcément besoin de l'exprimer. Il s'agit ici de recherche universitaire. Ce n'est qu'un exemple. Le but du jeu, c'est de ne pas s'arrêter à la possibilité de connecter tous les objets, mais de se demander en quels sont les moyens dont on dispose pour comprendre ce qui se passe dans un environnement sans avoir à le demander à l'utilisateur. Cela ouvre des opportunités, surtout pour les entreprises.

Dans quels domaines et pour quelles applications ?

Une entreprise qui, par exemple, fabrique des objets, va se demander quels services elles peut inventer au-dessus. Certains services existent depuis très longtemps déjà et l'on ne s'en rend pas compte. Tous les télécopieurs de bureau sont connectés à une ligne téléphonique et les fabricants qui les louent peuvent les surveiller pour savoir à l'avance si vous allez manquer d'encre, de papier, afin d'en livrer avant que vous ne veniez à en manquer. Il n'est pas nécessaire d'aller jusqu'à un dispositif aussi incongru qu'un Nabaztag pour imaginer les objets communicants qui vont arriver. La capacité à anticiper les besoins de l'utilisateur, à ressentir ce qu'il fait, à mettre en commun ce que font différents utilisateurs à un moment donné et de les comparer à d'autres... Google ne procède pas autrement. C'est en accumulant ces masses d'informations sur le comportement de millions d'internautes qu'il arrive à déterminer, à suggérer des comportements qui ont un sens pour d'autres utilisateurs. Observer ce que tout le monde boit comme café le matin et vous serez capable de prédire à un utilisateur particulier ce qu'il va aimer comme café, non seulement en observant son comportement, mais aussi celui des autres.

A quel horizon voyez-vous ces applications se concrétiser ?

Technologiquement, rien n'empêche de le faire demain. Pour que cela existe sur le marché, il faudrait compter trois ans. C'est globalement le temps de mettre au point le hardware, plus difficile à élaborer que le logiciel, et de le commercialiser. D'un point de vue technologique, on n'attend rien. On a tout ce qu'il faut. Il n'y a rien d'autre à inventer que ce qui est déjà sur le marché. Donc, il manque juste la volonté des industriels d'y aller. Mon rôle, en participant à des conférences comme l'USI, c'est de continuer à sensibiliser et à évangéliser. J'étais là au tout début de l'Internet, en 1994, et jusqu'en 1999, nous avons passé notre temps à convaincre nombre de grandes entreprises qui ne voyaient pas l'intérêt d'aller sur Internet. Au début, il faut faire ce travail-là. C'est un peu ingrat.

Vous avez créé une autre société, « Sen.se » dont la devise est cette fois « Feel, Act, Make Sens ». Quels sont vos objectifs ?

Sen.se, c'est avant tout une infrastructure qui permet de connecter n'importe quoi avec n'importe quoi. Ce peut être une source d'information par exemple, la météo, votre calendrier Google, votre poids transmis par votre balance Withings, toutes sortes de flux de données, personnels ou non, et puis des informations qui sont mesurées par des appareils comme des capteurs de chaleur dans votre domicile, votre accéléromètre, un mouchard installé dans votre voiture, des machines. De la même façon qu'il existe le Machine-to-Machine, nous définissons cela comme le Whatever-to-Whatever (n'importe quoi à n'importe quoi).

Vous utilisez une infrastructure de type cloud pour regrouper les informations ?

Absolument. Cette infrastructure, nous la déclinons de trois manières. Nous la mettons d'abord à la disposition d'entreprises qui voudraient mettre au point des objets communicants parce que, non seulement, il faut concevoir et fabriquer l'objet lui-même, mais encore faut-il qu'il se connecte à une infrastructure qui va gérer les services associés. C'est ce que nous proposons. C'est la partie « Business Sen.se » de notre activité. La deuxième partie s'appelle « Open Sen.se ». C'est celle que l'on voit quand on va sur notre site (http://open.sen.se/). Elle s'adresse aux designers, aux développeurs et à tous ceux qui veulent jouer avec cela. C'est gratuit. Vous avez développé vous-même votre petit appareil, vous avez détourné un Nabaztag ou un pèse-personne, par exemple, et vous pouvez commencer à imaginer vous-mêmes des usages en combinant des applications.

Vous fournissez des interfaces de programmation (API) ?

Il y a des API si vous avez envie d'écrire du code. Si vous n'en avez pas envie, nous proposons des applications toutes faites. Si vous voulez que votre plante verte vous envoie un « tweet » lorsqu'elle a besoin d'eau, vous pouvez le faire sans avoir à écrire de code du tout. Si vous voulez recueillir des températures à différents emplacements, obtenir une moyenne et recevoir cette information une fois par semaine, c'est possible. Nous utilisons de petites applications en ligne que vous allez configurer. L'idée, c'est d'imaginer des usages et de pas limiter ces possibilités à des développeurs.

Vous avez évoqué une troisième déclinaison de votre infrastructure.

C'est celle que nous démarrerons plutôt vers la fin de cette année, avec laquelle nous allons proposer aussi de nouveaux types d'appareils. Qui ne seront d'ailleurs pas exclusifs. Il sera possible d'utiliser nos appareils et ceux fournis par d'autres fabricants. Nous ne croyons pas à un monde fermé, mais à un monde dans lequel on trouve des données de toutes sortes de provenance. Il faut organiser tout cela autour de l'individu et non pas avoir un utilisateur qui butine d'un appareil à un autre comme s'il s'agissait d'un archipel d'objets.

(...)

Une batterie semi-liquide développée par le MIT

Sur les batteries traditionnelles, les fonctions de stockage et de dispense d'énergie sont réunies au même endroit. Ici, elles sont séparées grâce au liquide, visqueux et très dense Cela rend cette batterie bien plus efficace et permet de grandement diminuer sa taille dans les produits informatiques et électroniques comme dans les automobiles. Ce procédé pourrait en effet débarrasser les véhicules électriques de leur principal fardeau : le poids gênant de la batterie - celle de la Nissan Leaf pèse par exemple près de 300 kg.

Selon le MIT, il permet d'envisager plusieurs systèmes, comme un réservoir à vider ou remplir, à la manière d'un réservoir d'essence. Le liquide usé pourrait ainsi être renouvelé. On pourrait également avoir recours à des réservoirs amovibles et interchangeables, tout en gardant la possibilité de simplement recharger le matériel existant, lorsque les conditions le permettent.

Une technologie affinée et désormais moins coûteuse

L'utilisation de liquide n'est pas nouvelle. Cependant, le "Cambridge crude" est bien plus dense que ses prédécesseurs. Il est également moins coûteux à produire que les batteries au lithium des véhicules électriques d'aujourd'hui. Les chercheurs à l'origine de l'invention pensent qu'elle donnerait enfin aux voitures électriques la capacité de concurrencer pleinement les modèles traditionnels, chose que beaucoup espèrent voir arriver un jour.

L'année dernière, le Boston Consulting Group (BCG) avait conclu que l'absence d'une découverte majeure réduisant le coût des batteries, freinerait la progression des ventes de voitures électriques. Selon BCG, si tous s'accordent à voir en l'énergie électrique la bonne alternative aux énergies fossiles, le coût des batteries et les contraintes qu'elles imposent rendent pour le moment impossible leur généralisation. Le "Cambridge crude" constitue peut-être la réponse à cet enjeu.

(...)(26/05/2011 10:24:25)QFabric : Un switch Juniper taillé pour le cloud

Depuis plusieurs mois, les principaux équipementiers (Brocade, Cisco ou encore HP) ont dévoilé leurs fabric Ethernet ou matrices de commutation Ethernet. Juniper Networks n'est pas en reste avec les solutions issues de son projet Stratus démarré en 2006. Le résultat de ces années de recherche (100 millions de dollars d'investissement) porte désormais le nom de QFabric (Quantum Fabric) : un switch logique unique avec une intelligence distribuée et fédérée afin d'éviter les multiples opérations de lecture et autres traitements. Une topologie réseau ou chaque noeud est relié à tous les autres via un ou plusieurs commutateurs, ce qui permet de gérer des centaines de serveurs comme s'ils étaient connectés à un switch unique (voir illustration ci-dessous). Et pour assurer une compatibilité avec les anciens équipements (voir migration plus bas) pas question de Trill, une technologie en cours de standardisation pour interconnecter un grand nombre de liens en évitant la structure arborescente classique héritée du protocole Spanning tree.

Répondre à des besoins en hausse constante

Robyn Denholm, CFO de la compagnie californienne, qualifie cette plate-forme de « rupture aussi importante que l'arrivée du télégraphe, il y a 171 ans. L'accès à l'information n'importe où, n'importe quand est devenu la norme. (...) Et aujourd'hui, il y a déjà plus de terminaux mobiles connectés que de PC. Nous sommes obligés d'anticiper ces évolutions pour fournir les équipements adéquats ». Pour développer ses équipements, Juniper consacre ainsi pas moins de 20% de son chiffre d'affaires (4,1 milliards de dollars en 2010) à la R&D. Les trois piliers de QFabric (QF/Node, QF/InterConnect, QF/Director), Junos (l'os maison), Junos Space (la couche applicative) et Junos Pulse (fonctions de connectivité, de sécurité et d'accélération applicative) sont aujourd'hui les briques clefs des solutions de l'équipementier.

Le réseau, maillon faible du datacenter

Pour Alex Gray, directeur général en charge du groupe plateforme et systèmes chez Juniper, « les composants des datacenters (processeurs, virtualisation, stockage...) ont énormément progressé ces dernières années. Ce qui n'a pas suivi, c'est clairement le réseau. Aujourd'hui les clients construisent leur cloud pour aller vers une solution plus évolutive et le réseau est la fondation de cette architecture ». Discours classique chez les équipementiers, les fournisseurs de serveurs ou de solutions de stockage ou de virtualisation. Chacun veut tirer vers soi la couverture cloud computing. Pour revenir au réseau, Alex Gray estime que « le réseau est devenu trop complexe avec la multiplication des ports et des interactions. La structure arborescente dans un datacenter est une catastrophe, notamment avec les machines virtuelles et la multiplication des couches qui finissent par augmenter les temps de latence ».

La solution, Juniper l'a déjà exposée en février dernier avec un programme de migration en trois étapes puisqu'il est impossible de repartir de zéro. Les clients pourraient migrer progressivement vers la solution globale, même s'ils utilisent des équipements d'un autre fournisseur. Comme ils sont standardisés (via des interfaces Ethernet ou Fiber Channel), les modules de QFabric pourront être déployés en tandem avec l'infrastructure existante.

Déjà un client en France

Andy Ingram, directeur général en charge de l'activité datacenter chez Juniper, nous avoue avec réticence qu'un contrat a été signé avec un grand groupe français pour construire un cloud public reposant sur la technologie QFabric. « Les premiers utilisateurs de notre plate-forme QFabric sont ceux qui doivent résoudre un sérieux challenge dans leur centre de calcul. Les bourses, les places financières, toutes les entreprises qui veulent aller plus vite avec une infrastructure massive sont des clients potentiels. Une fois leur datacenter virtualisé, ils ne veulent plus gérer plusieurs réseaux. Avec VMware, pourquoi utiliser 5/6 connexions réseau physiques. Notre QFabric supporte Ethernet, FCoE, iSCSI et le FC en natif. Le principal frein reste que le marché du réseau est très conservateur, mais la convergence des réseaux est en marche (voir dossier LMI sur le sujet). »

Illustration : La direction générale de Juniper Networks (crédit : S.L.)

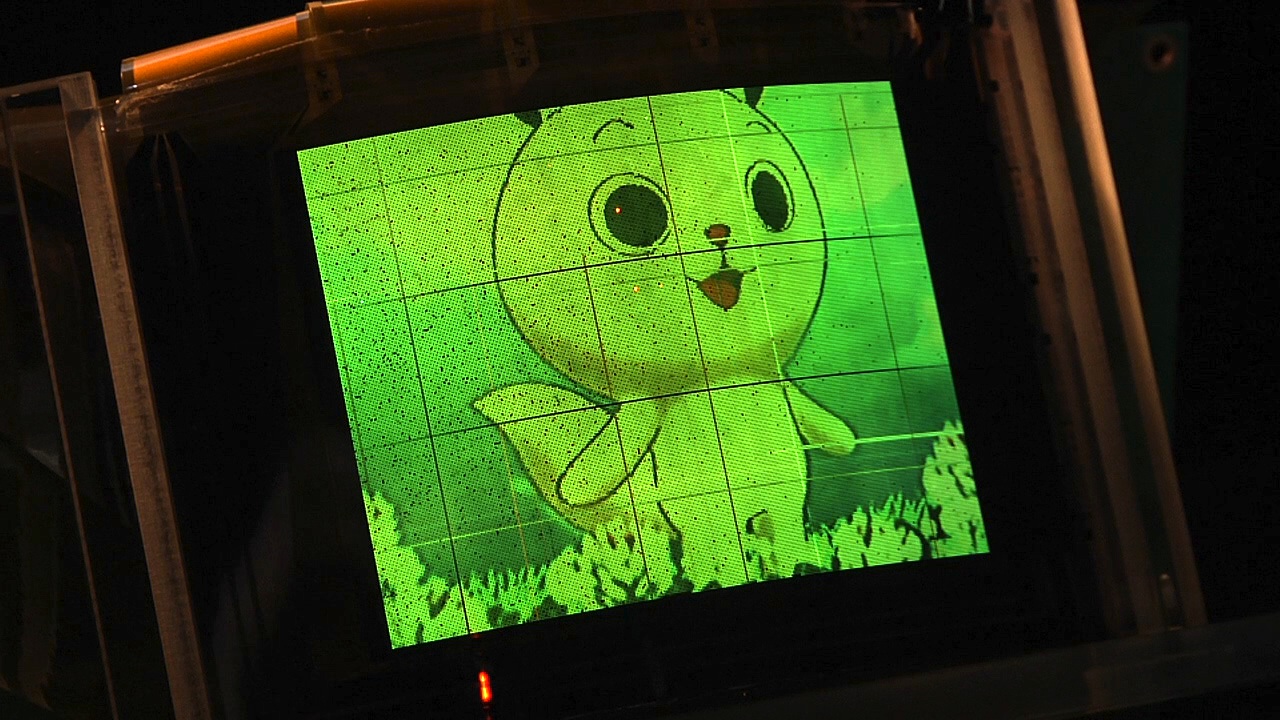

NHK présente son dernier prototype d'écran Oled flexible

Le japonais NHK travaille depuis plusieurs années sur les écrans Oled (diodes organiques électroluminescentes) et son dernier prototype sera présenté en grande pompe lors d'un évènement fin mai dans son centre de R&D à Tokyo. Les journalistes ont été invités à découvrir cet écran en avant-première.

Par rapport au prototype présenté il y a deux ans, ce nouveau modèle est plus facile à fabriquer. Comme les défauts à l'écran sont moins visibles, par rapport au prototype de 2009, les rebuts sont moins importants en production. Comme le précédent écran, la diagonale du modèle 2011 est de 5 pouces environ et supporte une résolution QVGA (320 x 240 pixels). Les images sont en couleur, même si la forte dominante des pixels verts impose une teinte générale verdâtre.

Des pixels morts très encombrants

Bien que le nombre de points imparfaits soit en diminution, leur présence toujours visible souligne que les chercheurs ont encore du chemin à parcourir avant de commercialiser ces écrans vidéo flexibles. Le plus gros problème rencontré lors de la fabrication de ces écrans reste la fiabilité des connexions électriques entre les pixels. Elles ne doivent pas se briser lorsque l'écran est fléchi. Même en utilisant un substrat ferme comme le verre, il y a encore certains obstacles à la technologie Oled qui empêchent la commercialisation de grands écrans sans défaut. La difficulté consiste à diffuser de manière uniforme le signal électroluminescent organique sur toute la surface de l'écran. Bien que les écrans Oled de petite taille sont largement utilisés dans les produits comme les téléphones mobiles, les dalles de 10 pouces et plus sont toujours difficiles et coûteuses à réaliser.

Une technologie toujours prometteuse

Mais les chercheurs ne baissent pas les bras car cette technologie d'affichage produit une image plus claire et plus dynamique que celle d'un écran LCD (affichage à cristaux liquides) et nécessite beaucoup moins de rétro éclairage. Et donc au final une consommation électrique inférieure.

En mai 2010, Sony avait montré un écran Oled de 4,1 pouces qui pouvait être

enroulé. Le prototype, qui n'est toujours pas produit commercialement, offrait une résolution de 432 x 240 pixels et pouvait être fléchi à un degré bien supérieur à celui du prototype de NHK. Seul bémol, les pixels défaillants étaient très nombreux.

André Brunetière devient directeur R&D et stratégie de Sage France

André Brunetière a la tête de la R&D et de la stratégie de Sage France. Un poste nouvellement créé qui consiste à assurer la cohérence entre la R&D et le marketing produits. La R&D proprement dite comprend 500 collaborateurs chez Sage France, sur un total de 2 400 salariés.

André Brunetière a débuté en 1988 chez Rhône Poulenc Agro, comme ingénieur de recherches, avant d'intégrer le cabinet de conseil en organisation Bruno de Courrèges, dont il devient le directeur en 1996. Deux ans plus tard, il rejoint l'éditeur de logiciels Abel, comme directeur des services, il en prend la direction générale en 2002. Abel est racheté par Adonix, lui-même repris par Sage.

En 2005, André Brunetière devient directeur des activités de services, au sein de la direction Moyennes et Grandes entreprises de Sage. En 2007, il devient directeur général d'une division, et, en 2009, directeur général des activités verticales. Il est membre du comité de direction de Sage France.

André Brunetière, 48 ans, est diplômé de polytechnique et docteur en sciences physiques.

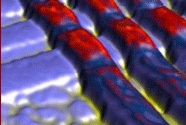

Memristor, HP affine la future technologie mémoire

Dans un article publié dans le journal «Nanotchnology » des chercheurs d'HP déclarent avoir découvert les interactions qui se déroulent à l'intérieur d'une memristor lors d'une impulsion électrique. Stan Williams, chercheur chez HP a déclaré « alors que nous sommes dans une optique de commercialisation de la technologie, cette découverte devrait améliorer considérablement ses performances ».

Les memristors comprennent une résistance avec de la mémoire et sont considérées comme le quatrième composant électrique passif (après le condensateur, la bobine et la résistance), selon les travaux du professeur Leon Chua, de l'Université de Californie à Berkeley en 1971. Les laboratoires d'HP ont démontré que ces « mémoires-résistances » pouvaient effectuer des calculs logiques. Avec cette capacité, les memristors peuvent travailler comme un processeur et un espace de stockage.

Memristor grossie au microscope électronique

Des rayons X pour dévoiler le dessous des memristors

Les scientifiques se doutaient qu'un processus de commutation avait lieu mais il était très difficile à étudier car memristors sont très petites. HP a utilisé les rayons X pour identifier un canal de seulement 100 nanomètres de large, là où le processus de commutation se déroule. Un nanomètre représente environ un millionième de centimètre. Les chercheurs ont ensuite analysé la composition chimique et la structure de ce canal. Ils ont ainsi acquis une meilleure idée sur le fonctionnent des memristors. Le document a été publié conjointement par HP et l'Université de Santa Barbara.

Le type de mémoire qui peut être construit avec memristors est appelé ReRAM. Elle est non volatile, ce qui signifie qu'elle peut conserver les données lorsqu'elle n'est pas alimentée électriquement. Ce qui n'est pas le cas pour la DRAM. Stan Williams estime que la technologie memristor HP pourrait être disponible dans le commerce d'ici mi 2013. Le constructeur s'est d'ailleurs allié avec Hynix pour développer et fabriquer ces produits. HP dispose déjà d'échantillons dans ses laboratoires qui embarquent des capacités de stockage de 12 Go par centimètre carré. Le chercheur a déclaré que la gravure serait réalisée en 15 nanomètres avec une architecture multi-niveaux, où quatre couches de mémoires seront empilées.

Illustration : Memristor

Crédit Photo: HP

(...)

CHI2011 : un prototype d'écran tactile qui accroche le doigt

Plusieurs prototypes d'interfaces ont été montrés lors de la conférence Computer Human Interaction (CHI) 2011 qui s'est tenue cette semaine, du 7 au 12 mai à Vancouver. Parmi ceux-ci était exposé un écran tactile qui présente une surface lisse ou adhésive en fonction de ce qui se passe à l'écran. Par exemple, si l'utilisateur déplace l'icône d'un fichier d'un endroit à un autre, son doigt glisse sur l'affichage puis s'arrête lorsque la tâche est effectuée, le doigt semblant alors adhérer à l'écran.

L'interface paraît réagir de façon réaliste, explique Vincent Levesque, en post-doctorat à l'Université de British Columbia. « Lorsque vous cliquez sur une icône, vous pouvez sentir une résistance et cela vous donne l'impression d'être davantage impliqué dans la tâche mise en oeuvre et dans l'interface ».

Proche de la sensation procurée par une table de « air hockey »

L'écran utilise une technologie différente de celle est utilisée quelquefois sur les smartphones. Avec cette dernière, l'utilisateur perçoit une vibration sur l'écran. Alors que les personnes ayant testé l'écran prototype sur la conférence CHI2011 ont plutôt ressenti que leurs doigts étaient repoussés de l'écran. Vincent Levesque compare la sensation à celle que l'on peut percevoir sur une table de « air hockey ».

Si l'écran prototype est relativement petit (une dizaine de ce ntimètres), il est en revanche présenté dans un boîtier assez grand et il utilise des lasers pour déterminer la position du doigt. L'équipe qui le développe explique qu'elle aimerait réduire sa taille et remplacer les lasers par une technologie de détection capacitive.

Illustration : Prototype frictional widgets (crédit photo : Nick Barber, IDGNS Boston) (...)

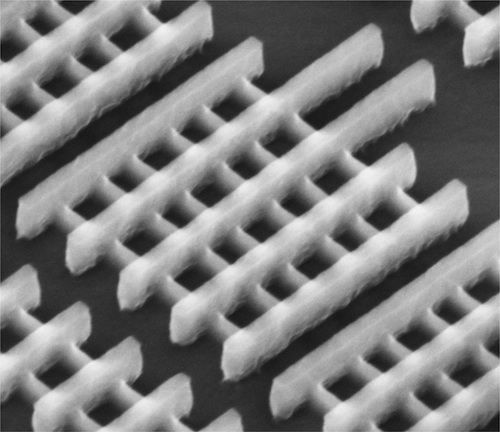

Des transistors 3D dans les futures puces Intel

« Cette nouvelle technologie processeur à transistors Tri-Gate remplacera les transistors plats à deux dimensions par une structure 3D, » a déclaré Mark Bohr, Senior Fellow d'Intel. Le transistor MOS (Metal Oxyde Semiconductor) planar classique à deux dimensions est remplacé par un mince aileron en trois dimensions qui sort verticalement du substrat de silicium. Autrement dit la zone active ne se trouve plus sous la grille, mais insérée dans la grille. « La technologie Intel permettra de créer des transistors plus rapides, plus petits et plus économes en énergie, » a ajouté Mark Bohr.

Cette technologie pourra bénéficier à différentes lignes de produits d'Intel, depuis les serveurs les plus rapides jusqu'aux puces basse énergie que l'on trouve dans les smartphones. « Nous devons continuellement innover pour créer de nouveaux matériels et de nouvelles structures», a déclaré à San Francisco Mark Bohr lors d'une conférence de presse diffusée sur Internet. « Avec le 22 nm nous apportons une nouvelle structure. »

Des puces plus rapides à terme

Les puces à transistors Tri-Gate seront 37 % plus rapides que les processeurs actuels d'Intel fabriqués selon le processus à 32 nm. Les transistors 3D consomment également deux fois moins d'énergie que les transistors 2D intégrés aux processeurs 32 nm. « Is seront également moins chers à produire, » a déclaré le chargé de recherche d'Intel. Comme l'a annoncé Dadi Perlmutter, vice-président exécutif et directeur général de l'Intel Architecture Group, les prochains processeurs Atom basse énergie, dédiés aux tablettes, aux netbooks, aux smartphones et aux terminaux numériques, bénéficieront de cette technologie. Les puces à transistors 3D seront « puissantes » en terme de performance et « économes » sur le plan de la consommation d'énergie, a ajouté le vice-président. « Le nouveau design pourrait aider Intel à rattraper les fondeurs concurrents qui fabriquent des processeurs à base de chip ARM, » a encore déclaré Dadi Perlmutter.

[[page]]

Considérés comme plus économes en énergie que les processeurs x86 d'Intel, ces processeurs ARM sont utilisés dans la plupart des tablettes et smartphones actuels. Selon Mark Bohr, Intel, qui mène des recherches sur le transistor Tri-Gate depuis une dizaine d'années, sera le premier fondeur à mettre cette technologie en fabrication. « D'autres entreprises se sont aussi intéressées aux transistors 3D, mais elles n'envisagent pas de les utiliser avant que la technologie de gravure à 14 nm ne soit au point, soit pas avant plusieurs années, » a avancé le chercheur. « Construire des processeurs, c'est comme construire des gratte-ciel : il faut ajouter plus de transistors tout en maintenant la densité et la taille des puces, » a encore déclaré Mark Bohr.

Revenir dans le cadre de la loi de Moore

Grâce au transistor 3D, Intel peut continuer à inscrire la technologie dans la loi de Moore, qui prône le doublement du nombre de transistors tous les deux ans. « Les difficultés rencontrées pour développer un modèle planar plus performant devenaient extrêmes, » a expliqué le chercheur. « La technologie des transistors 3D à l'air de concerner un détail obscur, mais elle ouvre des perspectives de développement importantes, » a déclaré Dean McCarron, analyste senior chez Mercury Research. « Nous avons tendance à perdre de vue que ce genre de technologie de haut niveau... est liée à la qualité d'un transistor, » a ajouté l'analyste.

« La structure en trois dimensions augmente les zones de contact sur les transistors, plus petits, mais sur lesquels on peut faire passer davantage de courant, » a indiqué l'analyste. C'est essentiel pour étendre la performance des transistors. « Les risques d'avoir un défaut sur une puce augmentent au fur et à mesure que l'on ajoute des couches à la verticale, » explique Dean McCarron. « Le fait qu'Intel ait décidé de se lancer dans la production prouve que le système est au point. Le fondeur doit encore faire les bons choix, » a estimé l'analyste.

Une nouvelle usine en Arizona

Tous les deux ans, Intel fait évoluer ses processus de fabrication et produit des puces plus petites qui offrent de meilleures performances, tout en étant moins gourmandes en énergie. Les premières puces - nom de code Ivy Bridge - à utiliser le processus à 22 nm seront destinées aux PC de bureau. Elles offriront entre autres un support matériel pour les dernières technologies graphiques DirectX 11. Intel a également déclaré qu'elle livrerait des processeurs 22 nm pour tablettes en 2013.

En octobre de l'année dernière, le fondeur avait annoncé qu'il allait investir entre 6 et 8 milliards de dollars US pour la fabrication de nouvelles puces pour PC, smartphones, appareils électroniques grand public et équipements embarqués. Une partie de ces investissements seront consacrés à la mise à niveau des usines pour fabriquer des puces 22 nm. En février dernier, l'entreprise de Redmond a également annoncé qu'elle allait investir 5 milliards de dollars pour construire une nouvelle usine en Arizona destinée à la fabrication de ces nouvelles puces. Celle-ci devrait être achevée en 2013.

| < Les 10 documents précédents | Les 10 documents suivants > |